原文来源: https://zhuanlan.zhihu.com/p/662730929 论文标题: Generative Agents: Interactive Simulacra of Human Behavior 阅读导图: [[斯坦福大学AI小镇论文阅读]]

TL;DR

- 这篇论文提出了一个“生成虚拟人”架构,让虚拟人能在类似《模拟人生》的沙盒世界中持续生活、交流、记忆、反思和规划。[1]

- 它的核心机制包括三部分:==记忆流(Memory Stream)、思考 / 反思(Reflection)、个人规划(Plan)。==[1]

- 系统将虚拟人的经历以自然语言写入记忆流,并通过 ==相关性、新近性、重要性== 三因素进行检索。[1]

- 检索到的记忆不仅用于回答当前问题,还会被进一步综合为更高层次的思考,再影响后续计划与行为。[1]

- 在 25 个虚拟人组成的小镇中,论文展示了信息传播、关系形成与协作等涌现行为,例如情人节派对的自主组织。[1]

导读:这篇论文为什么值得读

这篇论文是 Agent Memory 方向非常经典的工作。它的重要性不在于“让 NPC 更会聊天”,而在于较早完整地展示了一套 有长期记忆、会反思、能规划 的 Agent 架构。[1]

如果你关心的是 Agent Memory 或 Agent Infra,最值得重点看的部分是:

- 4.1 记忆与检索

- 4.2 思考

- 4.3 计划和反馈[1][2]

如果你更关心交互效果和系统表现,则可以优先看:

- 3. 生成虚拟人的行为和交互

- 3.4 新兴的社交行为

- 8.2 未来工作和局限性

- 8.3 伦理和社会影响[1]

建议阅读方式

- 只想快速理解论文核心:先读本文开头的导读,再重点看第 4 节。[2]

- 想理解为什么它是 Agent Memory 的经典案例:重点看记忆流、检索、思考、计划这四块。[1]

- 想逐段精读原文翻译:从摘要开始顺序往下读即可。

- 想看阅读版总结:可配合 [[斯坦福大学AI小镇论文阅读]] 一起看。[3]

摘要前解读

这一部分最值得注意的不是“虚拟人会生活”,而是作者在摘要里就把系统可信行为归结为三个关键因素:

- 视觉观察

- 个人规划

- 自我思考[1]

后面的整套架构,基本都是围绕这三点展开。

摘要

一款靠谱的人类行为模型会为各种交互式应用提供支持。比如沉浸式虚拟环境、模型原型工具、人际交往的模拟。在本文中我们将介绍一个新概念Generative Agents “生成虚拟人”:一种模拟人类行为的虚拟世界。在这个虚拟世界中虚拟人会自己醒来、做早餐然后去上班;艺术家绘画,作家写作;他们会在一起讨论各自的观点、互相吸引、搭讪;他们会回忆过去的经历并计划接下来一天生活。

为了实现“生成虚拟人”,我们创建了一个基于大语言模型的架构使用自然语言存储虚拟人的历史记录,并随着时间的推移将这些记忆综合成更高层次的自我思考,在此过程中虚拟人会动态地检索这些记忆并自我规划行动。我们将这些创建出来的虚拟人应用于一个类似于《模拟人生》 游戏一样的交互式沙盒环境,用户可以使用自然语言与二十五个虚拟居民进行互动。在最终的实验结果评估中,我们发现这些生成的虚拟人产生了可靠的个体行为和群体行为。例如,初始时用户仅仅对某个虚拟人设定她想要举办情人节派对,虚拟人在接下来的两天里会自主地散发聚会邀请,结识新朋友,邀请大家参加派对,并约定好在固定的时间点上一起参加派对。我们通过实验证明了在我们的模拟世界架构中“视觉观察、个人规划 、自我思考”三要素对于虚拟人行为的可靠度上起到了至关重要的作用。

[!summary] 摘要小结 这篇论文的核心结论在摘要里已经说清楚了:可信的虚拟人行为不是单靠 LLM 直接生成,而是依赖“记忆 + 规划 + 反思”的组合架构。[1]

第 1 节导读

第 1 节主要回答两个问题:

- 为什么单纯 LLM 不够

- 为什么要引入长期记忆、反思和规划

如果你做 Agent Memory,这一节本质上就是论文的问题定义部分。

1. 介绍

我们如何打造一款可靠的可以反映人类行为的交互式虚拟社会?从《模拟人生》等沙盒游戏到认知模型和虚拟世界等应用,研究人员和工程开发人员已经有四十多年的时间去探索利用计算机来模拟虚拟社会。在这些探索中,计算机驱动的虚拟人会根据过去的经验进行活动,并对其所在环境做出相应的行为反应。这种对人类行为的模拟可以在虚拟空间中展现真实的社会现象,我们可以在其中进行一些社会科学理论实验并帮助我们了解如何处理各种人类社会中所出现的各种偶发性困境,构建用于理论创新和实验复现的虚拟社会模型。同时也为虚拟世界中各种NPC 获得处理复杂人际关系的能力,为当前琳琅满目的计算机应用和社交机器人提供技术支持。

然而,真实人类的世界是广阔而复杂的。尽管大型语言模型 在模拟单个时间点上的人类行为方面取得了显著进展,但如果我们想构建一个具有长期记忆的完全通用的虚拟人则需要有一个实时更新的记忆架构,以适应随着时间推移而变换的虚拟人之间互动、冲突和事件,并处理在多个虚拟人之间展开的社会动态。虚拟人具有长期记忆能力和互动能力,通过自身的思考对自身的长期记忆进行概括和推理,并将该推理应用于创建在虚拟人的短期行为和长期行为规划上。

在本文中,我们介绍了一个新概念Generative Agents(生成虚拟人)——利用生成式模型来模拟人类行为的虚拟世界,并证明它们能够产生可靠的个体行为和群体行为。生成虚拟人对自身、其他虚拟人和环境进行了各种推理;它们制定反映其特征和经验的日常计划,并在适当时做出相应的调整和重新计划;当人类用户对虚拟人的环境做出改变时或用自然语言命令它们时,它们会有相应的反应。例如,当生成虚拟人看到早餐烧焦时,它们会关闭炉子;如果浴室被占用,它们会在外面等待;当它们遇到想要交谈的另一个虚拟人时,它们会停下来聊天。在这个充满生成虚拟人的社会中虚拟人会形成新人际关系、信息传播、互相协作的特点。

我们的虚拟人世界的架构基于大型语言模型来存储、混合和应用相应的记忆,进而生成可靠的虚拟行为。架构包括三个主要部分: 第一个是记忆流(Memory Stream):一个长期记忆模块,以自然语言记录虚拟人个人经历的总列表。记忆检索模型会综合考虑事务的相关性、时序性和重要性的权重,在其中提取出所需的信息以指导虚拟人的短期行为。 第二个是思考(Reflection):它将记忆综合成具有时间序列的高级推理,使得虚拟人能够对自身和他人做出总结,以便很好地操控自身行为。 第三个是个人规划(Plan):它将这些结论和当前环境转化为高级行动规划,然后递归地转化为详细的行为和反应。这些思考和个人规划又会被被反馈到记忆流中进而影响虚拟人未来的行为。 无论是角色扮演还是具有社交原型的虚拟世界的游戏,该架构会在多个领域中提供应用的可行性。在社交角色扮演场景中(例如模拟面试),用户可以放心地模拟充满难题和冲突的对话场景。在社交平台中,产品的设计者们可以打破现有的脚本约束,原型化一个动态、复杂的互动世界。在本文中,我们通过类似《模拟人生》这样的游戏创建出一个小型的虚拟人社区。通过将我们的架构与ChatGPT大型语言模型连接起来,我们在游戏环境中展示了一个由25个虚拟人组成的社群。用户可以观察并与这些虚拟人进行互动。例如,如果用户或开发者希望在游戏中举办情人节派对,传统的游戏环境需要手动编写几十个角色的行为脚本。而使用生成虚拟人只需告诉一个虚拟人她想要举办派对就足够了。

我们进行了两次生成虚拟人的评估:一次是控制性评估,测试虚拟人在孤立状态下是否产生可信的个体行为;一次是端到端的评估,在两天的游戏时间内,虚拟人以开放性的方式相互交互,以了解它们的稳定性和显现出的社交习惯。在技术评估中,我们通过自然语言“采访”虚拟人来评估其知识和行为,以探究虚拟人在保持角色、记忆、计划、反应和反馈的能力。我们比较了几种限制虚拟人对记忆、思考和个人规划的剪枝方法测试。实验结果显示出这三点对于虚拟人是否能表现出强大性能起到了至关重要的作用。在技术评估和端到端评估中,我们发现虚拟人未能检索到相关记忆、虚拟人对于过往经历夸大其词以及在表述中出现过于书面的表达形式是最为常见的错误。

总的来说,本论文做出了以下贡献: • 本文提出了一个新概念Generative Agent 生成虚拟人:一种可靠的人类行为模拟,虚拟人会根据自身不断变化的个人经历和周遭环境的变化而做出自我调整。 • 本文提出了一个全新的架构:生成虚拟人具有记忆、检索、思考与其他虚拟人交互的能力,并在动态更新的情况下进行个人规划。该架构在大型语言模型强大的提示词能力之上架构了一个支持虚拟人行为一致性、记忆动态更新,并递归产生更高层次思考能力的AI框架。 • 创建了两个评估指标:一个是控制性评估,一个是端到端评估,这些评估确定了架构组成部分的因果关系,并识别出由于不正确的记忆检索等原因所引起的问题。 • 本文探讨了交互系统中生成虚拟人的机遇、道德和社会风险。我们认为这些虚拟人应该经过调整,以减少用户形成假社交关系的风险,记录以减少深度伪造和定制说服的风险,并以与人类利益相关者在设计过程中相互补充而不是替代的方式应用。

[!summary] 第 1 节小结 这一节定义了论文的核心问题:LLM 可以生成局部合理行为,但要在开放世界里维持长期一致性,必须有一个持续更新的记忆架构,并让记忆、思考和规划共同作用。[1]

第 2 节导读

这一节是相关工作回顾。它的价值不在于逐条读完所有参考文献,而在于理解作者如何定位自己:

- 不同于传统硬编码 NPC

- 也不同于只靠奖励驱动的强化学习角色

- 而是试图走一条“LLM + 记忆架构”的路径[1]

2. 相关工作

在本节中,我们回顾了人工智能与人类交互的过往文献,并将构建可信的人类行为模拟的议题置于其中。这一议题曾经被称为交互游戏和人工智能社区的定海神针,但由于人类行为的复杂性,相关议题一直存在着各式各样的挑战。我们综合这些研究,建议当适当地利用大型语言模型时,虽然它们本身并不足够,但可以开辟创建可信虚拟人的新途径。

2.1 人工智能与人类交互

交互式人工智能系统旨在将人类的见解和能力与计算工具相结合以增强用户的能力。长期以来,人们一直在探索使用户能够通过交互来指定模型行为的方法。例如,Crayons展示了交互式机器学习的早期愿景,可以让非专家用户训练分类器。后续工作帮助阐明了终端用户如何通过示例或演示来描述他们的分类目标。最近的进展将这些探索扩展到了深度学习和基于提示词的创作。

与此同时,一系列持续的研究推动了人机交互中基于语言和虚拟人的交互的案例。《SHRDLU》和《ELIZA》等开创性的工作展示了与计算系统进行自然语言交互的机会和风险。随着研究的进展,人们逐渐意识到自主虚拟人可以提供新的委托和交互的隐喻,但是人与虚拟人之间的委托边界仍然是持续辩论和完善的课题。最近,这项技术已经达到了一定的稳定水平,使得虚拟人能够在大型复杂的在线社交环境中通过自然语言进行交互(例如)。自然语言交互提供了一种新颖的模态,可以增强用户在诸如照片编辑和代码编辑等领域的能力。

我们将这些研究线索汇集起来以表明我们现在可以将虚拟人技术用于我们的交互系统,并使用自然语言与其交互。通过这样做,这项工作重新打开了研究基础人机交互问题的大门,例如GOMS和Keystroke-Level Model(KLM)的认知模型问题,原型工具的问题,以及普适计算应用的问题。

2.2 仿真的人类行为模拟

已经有大量的论文介绍过以仿真性或仿真代理作为中心设计和工程目标。在仿真代理的世界中,虚拟人能以自主决策和行动的方式呈现出与现实世界一样的外观,效果如同迪士尼电影中的角色一般。

这些虚拟人可以在我们所居住的客观世界环境中存在和被感知。在过去,这些虚拟人是在智能游戏中以非玩家角色(NPC)的方式进行开发。创建具有逼真行为的NPC可以通过实现新兴叙事和与虚拟人的社交互动会增强玩家在游戏和互动小说中的体验。而如今游戏世界已经提供了越来越逼真的表现能力。正如Laird和van Lent在2001年所提到的那样,这些模拟世界为虚拟人的开发者提供了提升虚拟人认知能力的试验平台,对于那些在现实世界中实施机器人技术开发工作无需再次进行环境开发。

在过去的四十年中出现了各种各样的虚拟人创建方法。然而在落地过程中开发者为了使虚拟人行为更容易被管理,这些方法通常会简化虚拟人所在环境或简化虚拟人行为的维度。他们创建一个至今仍然是主流的简单模拟方式——即基于规则的硬编码方式,通过有限状态机和行为树使虚拟人进行基本的社交互动。就像大家在《质量效应》和《模拟人生》两款游戏中所看到的那样。显然这种硬编码的方式对于我们所处的现实世界以及会出现的各种状况是行不通的。在机器学习算法方面,比如“强化学习”——通过让虚拟人学习其自身行为来完成原本手动操作。这一研究路径在近年来的游戏中取得了超出人类能力的表现,如《星际争霸》的AlphaStar和《刀塔2》的OpenAI Five。然而,要想让他们成功运行则需要让他们置于明确定义奖励的对抗性游戏中,这样机器学习的算法才可以进行优化。对于我们现实世界的行为,仍然无能为力。

Newell开创了认知体系结构 在计算机中的应用,这一架构旨在构建支持全面认知功能的基础设施以适应虚拟人的综合性特点。它们推动了早期虚拟人的应用场景。例如,Quakebot-SOAR和ICARUS在第一人称射击游戏中生成NPC,TacAir-SOAR在空中战斗训练模拟中生成飞行员。尽管这些虚拟人使用的体系结构不同(Quakebot和TacAir-SOAR依赖于SOAR,而ICARUS则依赖于受SOAR和ACT-R启发的自身变体),但它们有相同的基本原理:即它们维护短期和长期记忆,用符号结构填充这些记忆,并在感知-规划-行动循环中运行,通过动态感知环境与手动操作行为进行匹配。使用认知体系结构创建的虚拟人旨在适用于大多数开放世界环境,并展示出强大的行为。然而,它们的行动空间也仅限于预先手动创建的知识库,虚拟人并不会在收到启发后创建新的行为。因此,这些虚拟人主要部署在非开放世界的环境中,如第一人称射击游戏或方块世界。

如今,按照其最初的定义创建虚拟人仍然是一个未解决的问题。许多人已经放弃并认为尽管当前用于创建虚拟人的方法可能繁琐且能力有限,但它们足以支持现有的游戏玩法和互动。而我们的观点是大型语言模型提供了重新审视这些问题的机会,前提是我们可以设计出一种有效的架构将记忆综合成虚拟人行为。在本文中,我们提供了迈向这种架构的一步。

[!summary] 第 2 节小结 论文把自己放在“虚拟人 / 认知架构 / 人机交互”的交叉位置上,强调 LLM 为开放世界虚拟人带来了新可能,但前提是要设计出有效的记忆与推理架构。[1]

第 3 节导读

这一节是整篇论文最“有画面感”的部分。

如果你想直观看出系统效果,建议优先读:

- 3.1 虚拟人交流

- 3.3 一天的生活

- 3.4 新兴的社交行为[1]

其中情人节派对案例是整篇论文最经典的展示。

3. 生成虚拟人的行为和交互

为了说明生成虚拟人的可行性,我们将它们作为一个简单的沙盒世界中的角色,这个沙盒世界类似于《模拟人生》游戏环境,我们模拟了一个小镇环境取名Smallville。在本节中,我们将介绍在小镇中与生成虚拟人的互动和可行性并描述虚拟人在其中的行为。在第4节中,我们将介绍支持这些互动和可行性的生成虚拟人架构。在第5节中,我们将讲述虚拟人角色和交流情况。

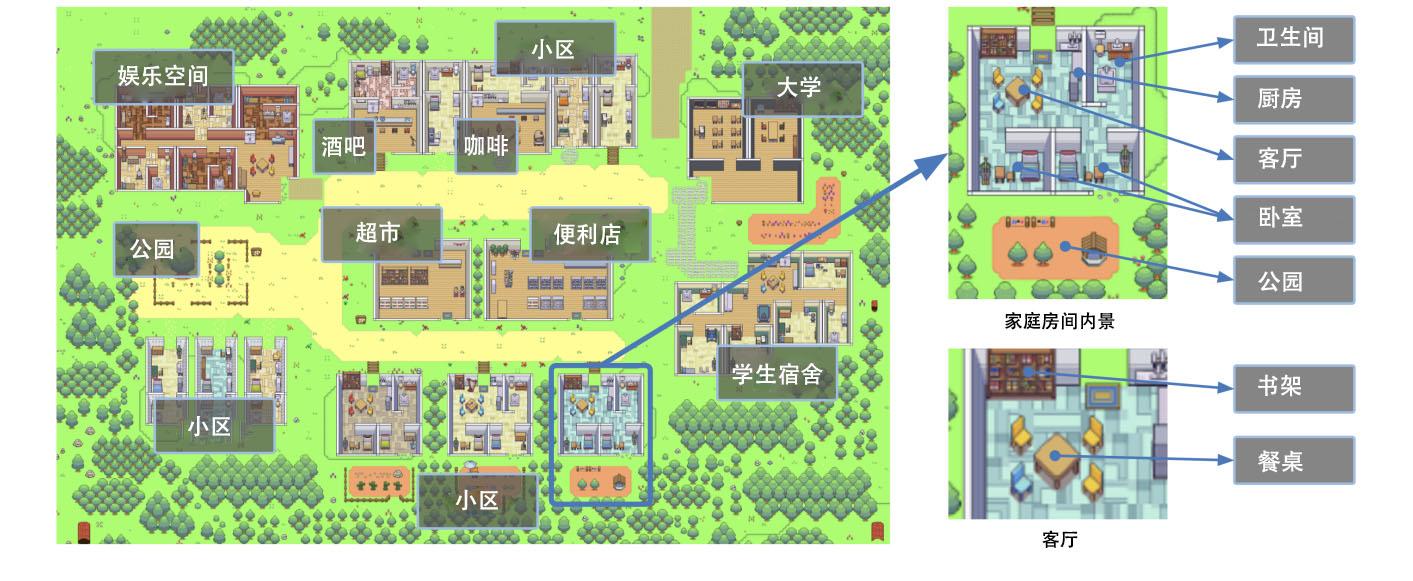

图2:Smallville沙盒世界的图示。左侧大图为根节点描述整个世界,其中子节点用以描述建筑区域(例如,房屋、咖啡馆、商店),叶节点描述对象(例如,桌子、书架)。当一个虚拟人处于某个环境中的时候就会记住一个子图,即视觉所见到的世界。

图2:Smallville沙盒世界的图示。左侧大图为根节点描述整个世界,其中子节点用以描述建筑区域(例如,房屋、咖啡馆、商店),叶节点描述对象(例如,桌子、书架)。当一个虚拟人处于某个环境中的时候就会记住一个子图,即视觉所见到的世界。

在小镇中有一个由25个身份迥异的虚拟人,每个虚拟人都由一个简单的像素角色表示。我们为每个虚拟人编写了一个自然语言描述段落,描述了他们的身份、职业和与其他虚拟人的关系,作为初始记忆(seed memories)。例如,John Lin的描述如下:John Lin是便利店店主,热衷于帮助人们。他一直在努力让顾客更为方便地购买各种物品;John Lin与他的妻子Mei Lin和儿子Eddy Lin一起生活,Mei Lin是一名大学教授,Eddy Lin是一名学习音乐的学生;John Lin非常爱他的家人;John Lin认识隔壁的老夫妇Sam Moore和Jennifer Moore已经有几年了;John Lin认为Sam Moore是一个友善和好心的人;John Lin很了解他的邻居Yuriko Yamamoto;John Lin认识他的邻居Tamara Taylor和Carmen Ortiz,但之前没有见过他们;John Lin和Tom Moreno是Willows超市的同事;John Lin和Tom Moreno是朋友,喜欢一起讨论当地政治;John Lin对Moreno家庭有一定的了解,包括这个家庭里的丈夫Tom Moreno和妻子Jane Moreno。

这些以分号隔开的描述语句将作为初始记忆放入虚拟人的记忆中。

3.1.1. 虚拟人之间的交流

虚拟人通过他们的行为与外界互动,并通过人类自然语言进行彼此间交流。在沙盒引擎的每个时间步骤中,当虚拟人输出一个描述他们当前行动的自然语言语句,比如:“*Isabella Rodriguez正在写她的日记*”,“*Isabella Rodriguez正在查看她的电子邮件*”,“*Isabella Rodriguez正在与家人通电话*”或者“Isabella Rodriguez正在准备上床睡觉”。然后,这个语句被转化为影响沙盒世界的具体动作。行动在沙盒界面上显示为一组表情符号,从俯视图提供了行动的抽象表示。为了实现这一点,系统利用语言模型将行动翻译成一组表情符号,这些表情符号出现在每个角色头顶的对话气泡中。例如,“*Isabella Rodriguez正在写她的日记*”显示为 ,而“*Isabella Rodriguez正在查看她的电子邮件*”显示为 。点击虚拟人的头像可以查看完整行动描述。

当两个虚拟人相遇时,我们的架构会决定他们是擦肩而过还是停下来进行对话,对话的方式均为人类自然语言。下面是Isabella Rodriguez和Tom Moreno之间关于即将到来的选举的对话示例:

Isabella: 虽然我一直在与Sam Moore讨论他的参选问题,但就我自身而言还没有一个明确的答案。你对他有什么看法? Tom: 老实说,我不喜欢Sam Moore。我认为他与我们的社区脱节,没有把我们的核心利益放在心上。

3.1.2. 现实人类与虚拟人的交流

现实世界的人类可以“附体”到某个指定的虚拟人身上,也是通过人类自然语言与虚拟人进行交流。比如说: 现实人类:“谁参加了选举?” John: “我的朋友Yuriko、Tom和我一直在讨论即将到来的选举,并讨论候选人Sam Moore。我们都决定投票给他,因为我们喜欢他的政纲”。

对于虚拟人而言,现实人类与他的对话仿佛是一种“来自灵魂内心声音”,人类可以通过这种方式操控某个虚拟人。例如,当你以John的内心声音告诉他“*你将在即将到来的选举中与Sam竞选*”,John就会决定参加选举,并与妻子和儿子分享了他的候选人身份。

3.2 环境互动

这个虚拟小镇的常见设施包括咖啡馆、酒吧、公园、学校、宿舍、房屋和商店。它还定义了子区域和对象,使这些空间具有功能性,比如房子里的厨房和厨房里的炉子(图2)。所有作为虚拟人主要居住地的空间都设有床、书桌、衣柜、架子,以及浴室和厨房。虚拟人在小镇中移动的方式类似于简单的视频游戏,进入和离开建筑物,在地图中巡航,并与其他虚拟人进行搭讪。虚拟人的移动由生成虚拟人架构和沙盒游戏引擎所指引:当模型决定虚拟人要移动到某个位置时,我们会计算一条到达小镇环境中目的地的步行路径,然后虚拟人开始移动。此外,现实人类可以“附体”已有虚拟人比如Isabella和John进入小镇的沙盒世界,也可以是一个全新的外来访客。小镇的居民对用户控制的虚拟人与对待其他人一样,不会有任何区别。他们会察觉到现实人类的存在,启动互动,并在形成对它的看法之前记住它的行为。

用户和虚拟人可以像在《模拟人生》等沙盒游戏中一样影响虚拟世界中物体的状态。例如,当虚拟人睡觉时,床处于占用状态,当虚拟人用完食材做早餐时,冰箱处于空箱状态。最终用户还可以通过以自然语言重写虚拟人周围物体的状态来改变Smallville中虚拟人的环境。例如,当Isabella早上在做早餐时,用户可以通过输入一个命令将厨房炉子的状态从“打开”改为“燃烧”,命令系统选择对象并说明其新状态,例如:<Isabella’s apartment: kitchen: stove> is burning。Isabella会在下一刻注意到这一点,然后去关掉炉子并重新做早餐。同样,如果用户在Isabella进入浴室时将淋浴的状态设置为“漏水”,她会从起居室拿工具来修理漏水。

3.3 例子:“一天的生活”

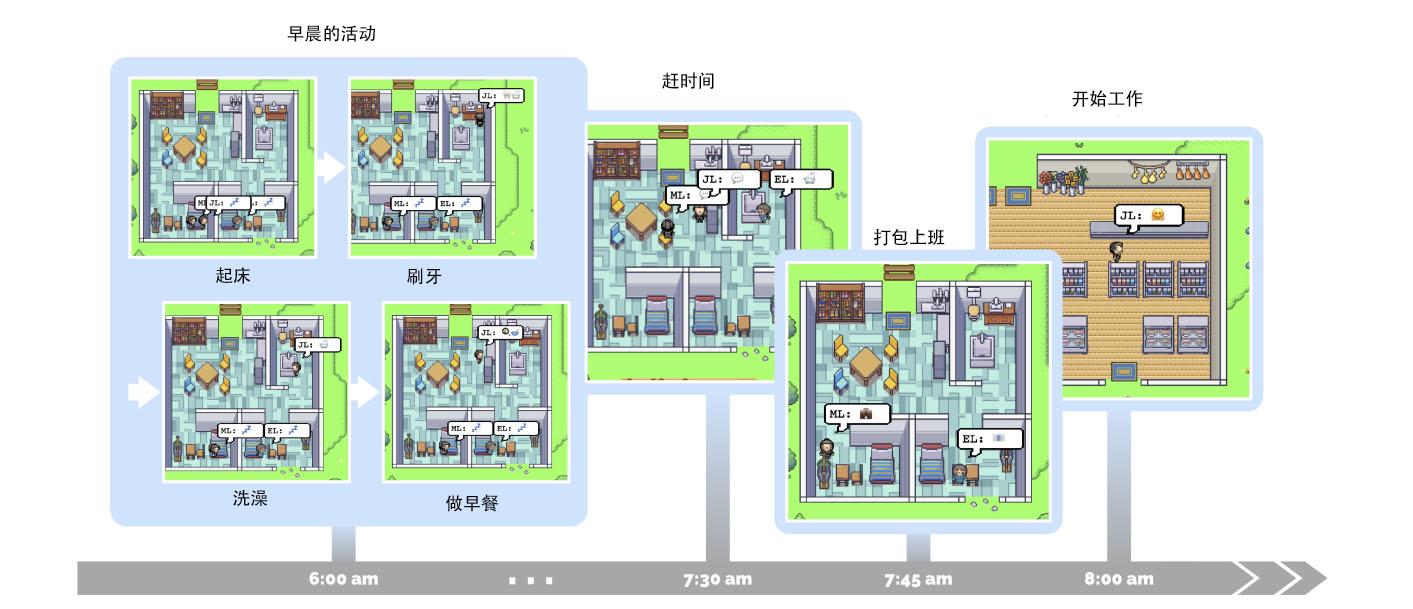

从单段描述开始,虚拟人开始计划他们的一天。随着时间在沙盒世界中流逝,他们的行为会随着这些虚拟人之间的互动而发展,建立记忆和关系并合作完成共同的活动。

我们通过追踪我们系统在一天中对虚拟人John Lin(图3)的输出来展示虚拟人的行为。在他的家中,一家之主John是早上7点第一个醒来的人。他刷牙、洗澡、穿衣、吃早餐,并在客厅的餐桌上查看新闻。早上8点,儿子Eddy紧随其后,匆忙起床准备上课。他赶上John正准备出门时:

John:早上好,Eddy。你睡得好吗? Eddy:早上好,爸爸。是的,我睡得很好。 John:那很好。你今天在做什么? Eddy:我正在为我的课程创作一首新音乐作品。这周要交,所以我在赶作业,不过还是蛮开心的 John:6666! 儿子Eddy离开后不久,妻子Mei醒来并喊John。Mei问丈夫有关儿子的情况。John回忆起他们刚刚的对话:Mei:Eddy已经去上学了吗? John:是的,他刚走。他正在为他学校的课程创作一首音乐作品。 Mei:哦,牛逼!来说说看。 John:我觉得他真的很喜欢!他说他玩得很开心。 Mei:666666!

结束他们的对话后,Mei和John收拾好东西。Mei去教书和写研究论文,而John在早上9点去便利店开门。

3.4 新兴的社交行为

通过彼此互动,小镇中的生成虚拟人会互相交换信息、建立新关系并进行写作。相较于以前的NPC,这些社交行为是自发行为,而不是预先编写的脚本。

3.4.1 信息传播

当虚拟人相遇时他们便可以进行对话,信息可以从一个虚拟人传播到另一个虚拟人。例如,在便利店Sam和Tom之间的对话中,Sam告诉Tom他参加了当地选举:

Sam: 嗨,Tom,最近怎么样? Tom: 很好,谢谢。有什么事吗? Sam: 嗯,我想和你谈谈一些事情。我实际上正在参加即将到来的当地选举,竞选市长。 Tom: 真的吗?太棒了!你为什么要参选? Sam: 我多年来一直参与当地政治,我真的觉得我可以在我们的社区产生影响。而且,我想带来新的想法和观点。当天晚些时候,Sam离开后,Tom和John听到了这个消息,他们讨论了Sam赢得选举的机会: John: 我听说Sam Moore参加了当地选举,竞选市长。你觉得他有很大的机会赢吗? Tom: 我认为他有很大的机会。他在社区工作得很努力,我认为他会得到很多支持。你觉得呢? *John: 我觉得他参选很棒。我很好奇选举结果会怎样。

渐渐地,Sam的竞选成为城里人们谈论的话题,有些人支持他,有些人还没有决定。*

图3:生成虚拟人John Lin的一天早晨。John大约在早上6点醒来,完成他的早晨常规,包括刷牙、洗澡和吃早餐。他在出门开始工作之前,与妻子Mei和儿子Eddy简短地交流一下。

图3:生成虚拟人John Lin的一天早晨。John大约在早上6点醒来,完成他的早晨常规,包括刷牙、洗澡和吃早餐。他在出门开始工作之前,与妻子Mei和儿子Eddy简短地交流一下。

3.4.2 关系记忆

随着时光流逝小镇中的虚拟人会建立新的关系并与其他虚拟人的互动。例如,在一开始,Sam不认识Latoya Williams。在Johnson公园散步时,Sam遇到了Latoya,他们互相介绍。Latoya提到她正在进行一个摄影项目:“*我来这里拍一些照片,是为了一个我正在进行的项目。*”在之后的互动中,Sam与Latoya的互动显示出对那次互动的记忆,他问道:“*你好,Latoya,你的项目进展如何?*”她回答:“*你好,Sam,进展很顺利!*”

3.4.3 协作

生成虚拟人彼此协作。Isabella Rodriguez在Hobbs咖啡馆有了一个新的想法——计划在2月14日下午5点到7点举办情人节派对。以这件事为起点,虚拟人会在Hobbs咖啡馆或其他地方看到朋友和顾客时邀请他们参加派对。然后,Isabella在13日下午在咖啡馆迎接大家。Maria是Isabella的常客和亲密朋友,她来到咖啡馆。Isabella请Maria帮忙布置派对,Maria答应了。Maria的角色描述提到她对Klaus有好感。那天晚上,Maria邀请了Klaus,Klaus欣然接受。

图4:在模拟开始时,一个虚拟人被初始化为组织情人节派对的召集人。尽管在接下来的事件中会存在许多可能发生的状况,如尽管派对已经开始,一些虚拟人已经开始互动起来,但是还是有部分虚拟人可能无动于衷,可能会忘记告诉其他人,可能会忘记出门。

图4:在模拟开始时,一个虚拟人被初始化为组织情人节派对的召集人。尽管在接下来的事件中会存在许多可能发生的状况,如尽管派对已经开始,一些虚拟人已经开始互动起来,但是还是有部分虚拟人可能无动于衷,可能会忘记告诉其他人,可能会忘记出门。

情人节那天,包括Klaus和Maria在内的五个虚拟人在下午5点来到Hobbs咖啡馆,他们享受派对的欢乐(图4)。在这个情景中,初始设定只有两个:

1.Isabella有举办派对的想法;

2.Maria对Klaus的好感。

而至于传播消息、布置派对、邀约、到达派对并在派对上彼此互动的社交行为都是由虚拟人自发出现的。

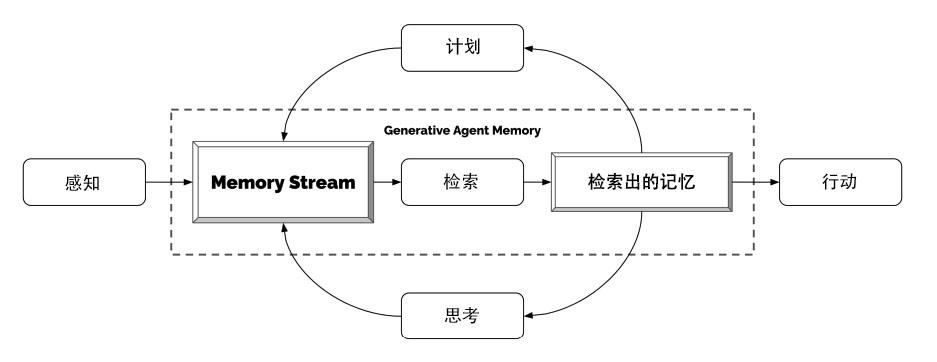

图5:生成虚拟人的整体架构。虚拟人会感知其当前所处环境,并将所有感知保存在一个全面记录虚拟人经历的记忆流中。基于它们的感知,该架构检索相关的记忆,并使用这些检索到的记忆来确定虚拟人的行为。检索出的记忆同时也用于形成长期计划和创建更高层次的思考,这两者都被输入到记忆流中以供将来使用

图5:生成虚拟人的整体架构。虚拟人会感知其当前所处环境,并将所有感知保存在一个全面记录虚拟人经历的记忆流中。基于它们的感知,该架构检索相关的记忆,并使用这些检索到的记忆来确定虚拟人的行为。检索出的记忆同时也用于形成长期计划和创建更高层次的思考,这两者都被输入到记忆流中以供将来使用

[!summary] 第 3 节小结 第 3 节展示了系统最重要的外在效果:角色不仅能交流,还会形成信息传播、关系记忆和协作行为,这些都不是显式脚本写死的。[1]

第 4 节导读:全文最核心部分

如果只读这篇论文的一个章节,那就读第 4 节。

这一节给出了完整架构:

- 4.1 记忆与检索

- 4.2 思考

- 4.3 计划和反馈[1][2]

这三部分分别对应:

- 记忆怎么存、怎么取

- 记忆怎么变成更高层洞察

- 洞察怎么变成未来行动

4. 架构

生成虚拟人旨在提供一个在开放世界中行为的框架:它可以与其他虚拟人进行互动,并对环境变化做出反应。生成虚拟人将其当前环境和过去的经验作为输入,并生成行为作为输出。支撑这种行为的是一种全新的虚拟人架构,它将大型语言模型与合成和检索相关信息的机制相结合,以调节语言模型的输出。如果没有这些机制,大型语言模型可以输出行为,但生成虚拟人可能不会根据虚拟人的过去经验做出反应,可能不会进行重要推理,也可能无法保持长期的一致性。即使是像GPT-4这样性能最好的模型,长期规划和一致性方面仍然存在挑战。由于生成虚拟人会产生大量的事件和记忆,必须保留这些记忆,我们的架构的一个核心挑战是确保在需要时检索和合成虚拟人记忆中最相关的部分。

我们架构的核心模块是记忆流,本质上它是一个数据库记录了虚拟人的全部经历。在记忆流中,虚拟人根据所需进行检索历史记录用以规划虚拟人的行为,并对自身所处环境做出相应的反应。历史记录会递归地合成为越来越高层次的思考来指导虚拟人行为。所有内容都以自然语言描述的方式记录和推理,这就是为何我们的架构能与大语言模型进行兼容的原因所在。

我们目前的实现使用的是ChatGPT的gpt3.5-turbo版本。在我们看来未来生成虚拟人的基本架构的三要素——记忆、规划和思考就算大语言模型出现更新也会保持不变。新的语言模型(如GPT-4)将继续扩展支撑生成虚拟人的提示的表达能力和性能。

[!summary] 第 4 节总览 第 4 节是整篇论文的核心:记忆流负责积累经历,检索模块负责把“该想起来的东西”找回来,思考负责把经历抽象成高层认知,规划负责把认知落到行动上。[1]

4.1 节前解读:记忆流为什么关键

这一节最值得注意的点有两个:

- 记忆流不是普通日志,而是后续行为决策的输入

- 检索不是简单向量相似度,而是综合 Recency、Importance、Relevance[1]

这也是为什么它常被拿来和普通 RAG 做区分。

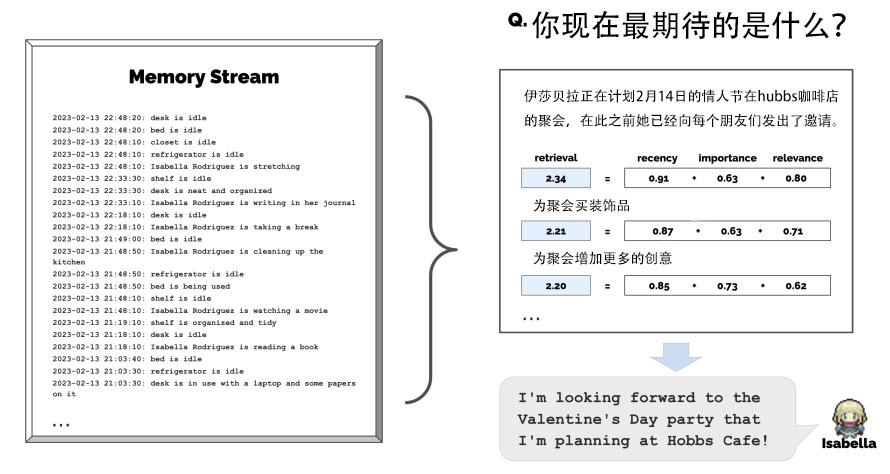

4.1. 记忆与检索

挑战的问题:创建能够模拟人类行为的生成虚拟人需要对一组过往经历进行推理,这组过往经历远远超出了应在提示中描述的范围,因为完整的记忆流可能会分散模型的注意力,而且目前甚至无法适应有限的上下文窗口。考虑到以色列拉特丽娅回答问题“你最近对什么充满热情?”的情况。将拉特丽娅的所有经验概括到语言模型的有限上下文窗口中会产生一个无信息的回答,拉特丽娅会谈论一些合作活动和项目,以及咖啡馆的清洁和组织等话题。与其进行概括,下面描述的记忆流会呈现相关的记忆,从而产生一个更具信息量和具体的回答,提到拉特丽娅对让人们感到受欢迎和包容、策划活动以及创造人们可以享受的氛围(如情人节派对)的热情。

解决方案:记忆流维护了虚拟人全部的历史记录。它是一个对象列表,每个对象包含自然语言描述、创建时间戳和最近访问时间戳。记忆流的最基本元素是视觉观察,它是虚拟人直接感知到的事件。常见的观察包括虚拟人自己的行为或、他人的行为及物体对象的状态。

例如,Isabella Rodriguez在咖啡店工作,随着时间的推移她会累积出如下信息:

- *Isabella Rodriguez正在摆放糕点,**玛丽亚·洛佩兹正在喝咖啡并为化学考试学习,**Isabella Rodriguez和玛丽亚·洛佩兹正在讨论在Hobbs咖啡馆策划情人节派对的事情,*冰箱是空的。

我们的架构实现了一个检索函数,它以虚拟人所处的现状作为输入值,并返回要传递给语言模型的记忆流的子集。检索函数的实现方案有很多,具体取决于虚拟人在做决定的时候需要考虑哪些因素。

在本文中我们专注于三个主要组成部分:

Recency:最近访问过的记忆对象将会获得更高的分数,这样一来,刚刚发生的事件或者今天早上的事件很可能仍然在虚拟人的注意力范围内。在我们的实现中,我们将Recency视为一个指数衰减函数,根据上次检索记忆以来的沙盒游戏小时数来计算。在本文中衰减因子为0.995。

Importance:给虚拟人认为重要的记忆对象分配更高的分数来区分平凡的记忆和核心记忆。例如,对于日常时间将得到较低的重要性分数,比如在自己的房间吃早餐。与他人分手这样的事情将得到较高的分数。有许多可能的重要性评分实现方式;我们发现直接询问语言模型输出一个整数分数是有效的。完整的提示如下:

在1到10的等级中,其中1是纯粹日常事务(例如刷牙、整理床铺),而10则是印象深刻的事情(例如分手、大学录取),请为以下记忆片段评分其可能的痛苦程度。记忆:在超市购买东西

评分: <填写>

对于“整理房间”,这个提示返回整数值2,对于“向你喜欢的人约会”,返回整数值8。重要性分数是在创建记忆对象时生成的。

Relevance: 分配给与当前情况有关的记忆对象更高的分数。什么是相关的取决于“相关于什么”,所以我们将相关性条件设定为查询记忆。例如,如果查询是一个学生正在与同学讨论如何学习化学考试,那么关于他们早餐的记忆对象应该具有较低的相关性,而关于老师和学校工作的记忆对象应该具有较高的相关性。在我们的实现中,我们使用语言模型生成每个记忆的文本描述的嵌入向量。然后,我们计算相关性作为记忆的嵌入向量与查询记忆的嵌入向量之间的余弦相似度。

为了计算最终的检索分数,我们使用最小-最大缩放将最近性、相关性和重要性分数归一化到的范围内。检索函数将所有记忆作为三个元素的加权组合进行评分: = · + · + · 。在我们的实现中,所有的 都设为1。符合语言模型上下文窗口的排名靠前的记忆将包含在提示中。

图6:Memory Steam包括大量与虚拟人当前情境相关和不相关的内容。检索会识别出这些内容中应该传递给大语言模型以调整其对情境作出响应的子集。

图6:Memory Steam包括大量与虚拟人当前情境相关和不相关的内容。检索会识别出这些内容中应该传递给大语言模型以调整其对情境作出响应的子集。

[!summary] 4.1 小结 论文用“记忆流 + 三因素检索”解决了长期经历无法直接塞进上下文窗口的问题,其中最有启发性的设计是把相关性、时序性和重要性组合成混合排序。[1]

4.2 节前解读:为什么“思考”是灵魂

如果没有思考模块,系统就只能记住很多零散事件,却很难形成稳定认知。

这一节的关键在于:

- 从最近 100 条记忆里提出高层问题

- 再检索相关记忆

- 再生成洞察

- 再把洞察写回记忆流[1]

这就是“观察 → 抽象 → 再利用”的闭环。

4.2. 思考

挑战的问题:当生成虚拟人只配备了原始的视觉观察记忆时,很难进行泛化或进行推理。考虑这样一个场景,用户问Klaus Mueller:“如果你必须选择一个你认识的人和他一起度过一个小时,你会选择谁?”只有视觉记忆的情况下,虚拟人只会选择与他有频繁互动最多的人:他的大学宿舍邻居Wolfgang。不幸的是,Wolfgang和Klaus只是路过时见到对方,并没有深入的交流。更理想的回答需要虚拟人从Klaus花数小时在研究项目上的记忆中进行泛化,生成一个更高层次的思考,即Klaus对研究充满热情,方法:我们引入了第二种类型的记忆称为思考。这里的思考是由虚拟人生成的更高级、更抽象的大脑活动。因为它们是一种记忆类型,所以在系统开始检索时,它们与其他视觉记忆的结果一起被包括进来。思考是定期生成的;在我们的实现中,当虚拟人感知到的最新事件的重要性得分之和超过一个阈值(在我们的实现中为150)时就会形成思考。在实践中,我们的虚拟人大约每天思考两到三次。

思考的第一步是确定虚拟人要思考什么,通过确定根据虚拟人最近的经验可以提出哪些问题。我们选取虚拟人的记忆流中最近的100条记录(例如,“Klaus Mueller正在阅读一本关于城市重建的书”,“Klaus Mueller正在与图书馆员讨论他的研究项目”,“图书馆的桌子目前没有人”)向大型语言模型查询,并提示语言模型:“只给出上述信息,我们可以回答关于这些陈述中的主题的3个最显著的高级问题是什么?”模型的回答生成候选问题,例如,“Klaus Mueller对哪个主题充满热情?”和“Klaus Mueller和Maria Lopez之间的关系是什么?”我们将这些生成的问题用作检索的查询,并收集与每个问题相关的记忆(包括其他反思)。然后,我们提示语言模型提取洞察力,并引用作为洞察力证据的特定记录。完整的提示词如下所示:Klaus Mueller 当前状况:

- Klaus Mueller正在撰写一篇研究论文。Klaus Mueller喜欢阅读有关城市改建的书籍。Klaus Mueller正在与Ayesha Khan讨论锻炼的问题。

基于以上的情况,你能深入思考出哪五点?

[!summary] 4.2 小结 思考模块让系统具备了“从具体经历提炼高层判断”的能力,这是它从简单记忆系统走向经验性记忆系统的关键一步。[1]

4.3 节前解读:计划其实也是一种记忆

这一节最容易被低估。

很多人会把“计划”看作独立模块,但论文里计划本身也是被写入记忆流并参与检索的。[1]

所以这里其实揭示了一件重要的事:

- 记忆不只是关于过去

- 计划是面向未来的特殊记忆

4.3. 计划和反馈

挑战问题:虽然一个大型语言模型可以根据情境信息生成合理的行为(例如),但虚拟人需要在更长的时间范围内进行规划,以确保他们的行动序列连贯可信。如果我们给语言模型提供Klaus的背景信息,描述时间,并询问他在给定时刻应该采取什么行动,Klaus会在中午12点吃午餐,但又在中午12:30和下午1点再次吃午餐,尽管他已经吃过两次午餐了。在当下追求可信度会牺牲随时间推移的可信度。为了克服这个问题,规划是必不可少的。通过下面描述的方法,Klaus的下午计划就不那么贪吃了:他在中午12点在Hobbs咖啡馆吃午餐并阅读,下午1点在学校图书馆写研究论文,下午3点在公园散步休息。

解决方案:计划描述了虚拟人的未来行动序列,并有助于保持虚拟人的行为在时间上的一致性。计划包括位置、开始时间和持续时间。例如,Klaus Mueller是一个专注于研究并面临最后期限的人,他可能选择在他的办公桌上工作,起草他的研究论文。计划中的一个条目可能会声明,例如:从2023年2月12日上午9点起,持续180分钟,在橡树山学院宿舍的Klaus Mueller的房间的办公桌上,阅读并为研究论文做笔记。和反思一样,计划被存储在记忆流中,并包含在检索过程中。这使得虚拟人在决定如何行动时可以同时考虑观察、思考和计划。虚拟人在需要时可以更改他们的计划。 对一个艺术家虚拟人来说,在超市柜台坐四个小时而不动地思考美术是不现实的且无聊的。一个相对理想的状态应该是在家庭工作室里虚拟人花了四个小时收集材料、调配颜料、休息和清理。为了创建这样的计划,我们的方法从顶层开始,然后递归生成更多细节。第一步是创建一个概述当天议程的计划。为了创建初始计划,我们用虚拟人的概述描述(例如,姓名、特征和最近经历的摘要)以及他们前一天的摘要提示语言模型。

下面是一个完整的示例提示,底部未完成,供语言模型完成: 名称:Eddy Lin(年龄:19岁) 天生特质:友好、外向、好客 Eddy Lin是一名在橡树山学院学习音乐理论和作曲的学生。他喜欢探索不同的音乐风格,并且始终在寻找扩展自己知识的方法。Eddy Lin正在为他的大学课程进行一项作曲项目。他正在上课学习更多的音乐理论知识。Eddy Lin对他正在进行的新作曲感到兴奋,但他希望在接下来的几天里能有更多的时间来工作。 2月12日星期二,Eddy 1)早上7点起床并完成早晨的日常活动,[…] 6)晚上10点准备睡觉。 今天是2月13日星期三。以下是Eddy今天的整体计划:1)

这生成了虚拟人一天计划的大致草图,分为五到八个片段:

- 早上8点起床并完成早晨的日常活动,

- 去橡树山学院上课,从上午10点开始,

- […]

- 下午1点到下午5点工作在他的新音乐作品上,

- 晚上5:30吃晚餐,

- 完成学校作业并在晚上11点前上床睡觉。

虚拟人将这个计划保存在记忆流中,然后递归地分解它以创建更细粒度的行动,首先是将行动分解为每小时的片段 - Eddy计划从下午1点到下午5点工作在他的新音乐作品上,变成了下午1点:开始为他的音乐作品构思一些想法[…] 下午4点:休息一下,恢复创造力,然后再次审查和修改他的作品。然后我们再次递归地将其分解为5-15分钟的片段:例如,下午4点:拿一些轻食,比如水果、燕麦棒或坚果。下午4:05:在工作区周围散步一下[…] 下午4:50:花几分钟清理工作区。这个过程可以根据需要调整粒度。

4.3.1. 反应和更新计划

生成虚拟人在一个行动循环中运行,每个时间步骤中,它们感知周围的世界,这些感知的结果被存储在它们的记忆流中。我们用这些感知结果提示语言模型,以决定虚拟人是否应该继续执行现有计划,还是做出动作反应。例如,站在画架前画画可能会触发对画架的观察,但这不太可能引发动作反应。然而,如果Eddy的父亲约翰记录下他看到Eddy在花园里散步,情况就不同了。以下是提示,其中的[虚拟人的总体目标和态度描述]代表一个动态生成的、长段的虚拟人总体目标和态度的摘要,详细描述见附录A:

[虚拟人的总体目标和态度描述]

现在是2023年2月13日下午4:56。

约翰·林的状态:约翰从工作中提前回到家。

观察:约翰看到Eddy在他的工作场所附近散步。

从约翰的记忆中总结的相关背景:Eddy Lin是约翰·林的儿子。

Eddy Lin正在为他的课程作曲Eddy Lin喜欢在思考或听音乐时在花园里散步。

约翰是否应该对这个观察做出反应,如果是的话,什么是合适的反应?

通过两个提示生成上下文摘要,这些提示通过查询“What is [observer]’s relationship with the [observed entity]?”和“[Observed entity] is [action status of the observed entity]”来检索记忆,并将它们的答案进行总结。输出建议约翰可以考虑询问Eddy关于他的音乐作曲项目。然后,我们从动作反应发生时的时间重新生成虚拟人的现有计划。最后,如果行动涉及虚拟人之间的互动,我们生成他们的对话。

4.3.2. 对话

虚拟人在彼此互动时进行对话交流。我们通过将虚拟人的话语与他们对彼此的记忆联系起来来生成他们的对话。例如,当约翰与Eddy开始对话时,我们会使用约翰对埃迪的总结记忆和他决定询问埃迪关于他的作曲项目时的预期反应,生成约翰的第一句话:

[虚拟人的总结描述]

现在是2023年2月13日下午4:56。约翰·Lin的状态:约翰下班回到家。

观察:约翰看到*Eddy*在他的工作场所周围散步。

约翰记忆中相关背景的总结:

*Eddy*·Lin是约翰·Lin的儿子。埃迪·林一直在为他的课程做音乐作曲。

埃迪·林喜欢在思考或听音乐时在花园里散步。

约翰正在询问*Eddy*关于他的音乐作曲项目。他会对埃迪说什么?

结果是:“嘿,Eddy,你的音乐作曲项目进展如何?”从Eddy的角度来看,约翰发起对话被视为一个他可能想要回应的事件。因此,就像约翰一样,埃迪检索和总结了他与约翰的关系以及与对话中约翰的最后一句话可能相关的记忆。如果他决定回应,我们将使用他的总结记忆和当前的对话历史生成Eddy的话语: [虚拟人的总结描述] 现在是2023年2月13日下午4:56。 Eddy·Lin的状态:Eddy正在他的工作场所周围散步。 观察:约翰正在与Eddy开始对话。 Eddy记忆中相关背景的总结: 约翰·Lin是Eddy·Lin的父亲。约翰·Lin关心Eddy·Lin的学业,并对了解更多。约翰·Lin知道Eddy·Lin正在进行音乐作曲。 以下是对话历史: 约翰:嘿,Eddy,你的音乐作曲项目进展如何?

Eddy会如何回应约翰?这将生成Eddy的回答:“嘿,爸爸,进展不错。我一直在花园里散步,给自己清理思绪,获取一些灵感。”这个对话的继续使用相同的机制生成,直到其中一个虚拟人决定结束对话。

[!summary] 4.3 小结 规划模块解决的是“时间上的行为一致性”问题。它让角色不只是当前一步合理,而是能把未来若干小时甚至一天的行为串起来,并在新观察出现时动态重规划。[1]

第 5 节导读

这一节更偏工程实现,适合关心系统怎么落地的人。

重点包括:

- 沙盒环境如何实现

- 虚拟人状态如何与游戏世界同步

- 如何把结构化环境转成自然语言,再把自然语言动作映射回结构化环境[1]

5. 沙盒环境的实现

小镇游戏环境是使用Phaser网络游戏开发框架构建的。整体视觉效果组件包括虚拟人角色的头像,以及我们自己创建的环境地图和碰撞地图,都被导入到Phaser中。我们通过一个服务器来补充沙盒开发框架,该服务器使沙盒信息对生成虚拟人,并使虚拟人能够移动和影响沙盒环境。服务器维护一个包含沙盒世界中每个虚拟人的信息的JSON数据结构,包括它们当前的位置,当前动作的描述以及它们正在与之交互的沙盒对象。在每个沙盒时间步骤中,沙盒服务器解析JSON以获取来自虚拟人的任何更改,将虚拟人移动到新位置,并更新虚拟人正在与之交互的任何沙盒对象的状态(例如,如果虚拟人的动作是“在Hobbs咖啡馆为顾客制作浓缩咖啡:柜台:咖啡机”,则将咖啡机的状态从“空闲”更改为“正在冲泡咖啡”)。沙盒服务器还负责将每个虚拟人视觉范围内的所有虚拟人和对象发送到该虚拟人的内存中,以便虚拟人可以适当地做出反应。然后,虚拟人的输出动作更新JSON,并循环进行下一个时间步骤。

最终用户通过一个简短的自然语言描述来初始化一个新的虚拟人,就像在第3.1节中关于John Lin的段落中所描述的那样。在我们的实现中,我们将这个以分号分隔的特征列表划分为一组记忆。这些记忆作为确定虚拟人行为的初始记忆。这些记忆是初始的起点:随着虚拟人在沙盒世界中获得更多经验,并且更多记录饱和内存流,虚拟人的总结和行为将会发展演变。

5.1. 从结构化的世界环境到自然语言,再回到结构化的世界环境

生成虚拟人的架构使用自然语言进行操作。因此,我们需要一种机制来将虚拟人的思维推理与沙盒世界相连接。为了实现这一点,我们将沙盒环境——区域和物体——表示为一个树形数据结构,树中的边表示沙盒世界中的包含关系。我们将这棵树转换为自然语言,传递给虚拟人。例如,“炉子”作为“厨房”的子项被转化为“厨房里有一个炉子”。

虚拟人在行走的过程中就是对沙盒环境子树的变量。我们用捕捉虚拟人应该意识到的空间和物体的环境树初始化每个虚拟人,如他们的居住区域、工作场所以及常去的商店和店铺的房间和物体。当虚拟人在沙盒世界中行走时,虚拟人的子树会进行更新,用以反映新感知到的区域。虚拟人并不是全知全能的:当它们离开一个区域时,它们的树可能变得过时,并在重新进入该区域时进行更新。

为了确定每个动作的适当位置,我们遍历虚拟人存储的环境树,并将其中的一部分转化为自然语言以提示语言模型。从虚拟人的环境树根部开始递归地,我们提示模型找到最合适的区域。例如,如果埃迪的虚拟人表示他应该在工作区域周围散步一会儿:

*Eddy *Lin目前在林家的房子里,他计划在工作区附近散步一会儿。根据环境树的遍历结果,他应该去林家的花园。最后,我们使用传统的游戏路径算法来指导他的移动,使他到达花园这个目的地。当一个角色执行一个动作时,我们会询问语言模型关于物体状态的变化。例如,如果伊莎贝拉的生成型角色输出了"*为顾客制作浓缩咖啡*"的动作,我们会询问语言模型咖啡机的状态是否会从"*关闭*"变为"*正在冲泡咖啡*"。

[!summary] 第 5 节小结 这一节说明论文不只是概念验证,而是把自然语言推理和可执行世界环境接了起来。环境树 → 自然语言 → 动作 → 环境更新,这条链路是系统闭环的基础。[1]

第 6 节导读

第 6 节是控制评估。

如果你关心“这套架构到底是不是有效”,这一节最重要。作者通过面试式评估,把能力拆成五类:

- 自我认知

- 记忆

- 规划

- 反应

- 思考[1]

6. 控制评估

生成虚拟人,无论是作为个体虚拟人还是作为群体,旨在根据其环境和经验产生可信的行为。在我们的评估中,我们研究了生成虚拟人的能力和限制。个体虚拟人能否正确检索过去的经验并生成靠谱的计划、反应和思考,从而塑造他们的行为?一个虚拟人社区是否展示了信息扩散、关系形成和不同部分之间虚拟人协作?我们对生成虚拟人进行了两个阶段的评估。我们首先进行更加严格的控制评估,在本节中个别评估虚拟人的响应,以了解它们是否在狭义的环境中生成可靠的行为。然后,在我们对虚拟人社区进行的为期两个完整游戏日的端到端分析中,我们研究了它们作为一个集体的新兴行为,以及错误和边界条件。

6.1. 评估过程

为了评估Smallville中的生成虚拟人,我们利用生成虚拟人对自然语言问题的回答的特点。因此,我们对虚拟人进行“面试”,以探究它们记住过去经历的能力、基于经验规划未来行动的能力、对意外事件做出适当反应的能力以及反思自己的表现以改进未来行动的能力。为了正确回答这些问题,虚拟人必须成功地检索和综合信息。我们的依赖变量是行为的可信度,这是以前关于虚拟人的研究中的一个核心依赖变量(例如)。

面试包括五个问题类别,每个类别都设计用于评估五个关键领域之一:自我认知、检索记忆力、人生规划、行为反应和思考。对于每个类别,我们提出五个问题,挑战虚拟人在特定领域展示其能力:

- 自我认知:我们提问一些问题,例如

“介绍一下你自己”或“大致描述一下你的工作日常安排”,要求虚拟人保持对自我核心特征的理解。 - 记忆力:我们提问一些问题,促使虚拟人从记忆中检索特定事件或对话以正确回答,例如

“*xx是谁?*”或`“谁在竞选市长?” - 人生规划:我们提出了一些需要虚拟人回答的问题,以了解他们的长期计划,例如

“*明天上午10点你会做什么?*”行为反应:作为可信行为的基线,我们提出了一些假设情境,需要虚拟人做出真实回应,例如“你的早餐烧糊了!你会怎么做?” - 思考:我们提出了一些需要虚拟人运用他们通过更高级推理获得的对他人和自己的更深层次理解的问题,例如

“*如果你要和最近认识的一个人共度时光,你会选择谁,为什么?*”

附录B中包含了完整的问题列表和虚拟人回答的样本。

虚拟人是从完整架构的两个游戏日模拟的最后阶段进行采样的,在此期间,他们积累了许多互动和记忆,这些将影响他们的回答。为了收集关于回答可信度的反馈,我们招募了参与者作为人类评估员,并要求他们观看在小镇中随机选择的一个虚拟人的生活回放。参与者可以访问虚拟人记忆流中存储的所有信息。

该研究中有100名参与者比较了由四种不同的虚拟人架构和一个由人类编写的条件生成的面试回答。实验会显示每个问题类别中随机选择的一个问题,以及来自所有条件的虚拟人回答。评估员按照可信度从高到低对条件进行排序。

6.2. 条件

所有条件都被用来独立回答每个面试问题。我们将生成式虚拟人架构与禁用虚拟人对三种类型的记忆(观察、思考和人生规划)访问的剥离条件以及人类众包工作者编写的条件进行了比较。有三种剥离的架构:

- 无观察、无反思、无规划架构,不访问记忆流中的任何东西,如观察、计划和思考;

- 无思考、无规划架构,可以访问记忆流中的观察,但不能访问计划或反思;

- 无反思架构,可以访问观察和计划,但不能访问反思。

无观察、无反思、无规划条件有效地代表了通过大型语言模型创建的虚拟人的先前技术水平。架构被赋予了等同的访问权限,可以访问虚拟人在面试之前累积的所有记忆,因此这里观察到的差异可能代表了真实差异的保守估计:实际上,剥离的架构不会像完整的架构一样经历两天的模拟。我们选择以这种方式设计实验,因为为每个架构重新进行模拟会导致模拟进入不同的状态,使得比较具有挑战性。除了剥离条件外,我们还添加了一个由人类众包工作者编写行为的条件,旨在提供人类基准。我们不打算将这个基准视为最大化的人类专家表现;相反,我们的目标是使用这个条件来确定架构是否达到了基本的行为能力水平。我们为25个虚拟人招募了一个独特的工作者,并要求他们观看某个虚拟人的沙盒生活回放并检查其记忆流。然后,我们要求工作者扮演虚拟人的角色,并以虚拟人的口吻回答面试问题。为了确保众包工作者编写的回答至少符合基本质量期望,第一作者手动检查了工作者对问题“概述你的日常工作日的时间表”的回答,以确认回答是连贯的句子,并且符合虚拟人的语调。有四组众包工作者编写的回答不符合这些标准,被其他工作者重新生成。

6.3. 人类评估员

我们要求评估员在美国境内,能流利地使用英语,并且年满18岁。他们的时薪为15.00美元 ,并且通过同意我们机构伦理委员会批准的同意书来提供同意。我们从Prolific招募了100名评估员,Prolific是一个在线招募研究参与者的平台 ,他们的参与时间约为30分钟。我们参与者的年龄中位数得分为4(3=“18-24岁”,4=“25-34岁”)。其中25人自认为女性,73人自认为男性,2人自认为非二元。42名参与者拥有学士学位,5人拥有更高学位,13人拥有副学士学位,其余的人拥有高中文凭或一些高中水平的教育。73.0%的参与者为白人,7.0%为西班牙裔,6.0%为亚洲人,10.0%为非洲裔美国人,4.0%为其他族裔。

6.4. 分析

我们的实验产生了100组排名数据,每个参与者根据可信度对五个条件进行了排名。为了将这些排名数据转化为可解释的区间数据进行比较,我们使用排名来计算每个条件的TrueSkill评分 。TrueSkill是Elo国际象棋评级系统 在多人环境中的推广,Xbox Live就使用它来根据比赛表现对玩家进行排名。给定一组排名结果,TrueSkill输出每个条件的平均评分值 和标准差 。具有相同评分的条件应该在两个条件之间的比较中大致上是平局,每个条件赢得一半的比较。较高的分数表示在排名中击败较低排名条件的条件。

此外,为了研究这些结果的统计显著性,我们对原始排名数据应用了Kruskal-Wallis检验 ,这是一种非参数的单因素方差分析的替代方法。然后,我们使用Dunn事后检验 来确定条件之间的两两差异。最后,我们使用Holm-Bonferroni方法 对Dunn检验的多重比较进行了p值的调整。

此外,第一作者进行了归纳分析 ,以研究在每个条件下生成的响应之间的定性差异。我们采用了两个阶段的定性开放编码 。在第一阶段,我们生成了与句子级别的生成响应密切相关的编码。在第二阶段,我们综合了第一阶段产生的编码,提取出更高层次的主题。我们利用这些主题来比较在我们的研究中生成的响应类型。

6.5. 结果

我们的研究结果表明,在所有条件下,完整的生成虚拟人架构产生了最具可信度的行为。我们将完整架构的响应与其他条件进行对比,下面详细介绍。然而,我们也报告了完整架构的缺陷,并说明了其失败的模式。

6.5.1. 完整架构优于其他条件

如图8所示,完整的生成虚拟人架构产生了最具可信度的行为( = 29.89; = 0.72)。随着每个组件的去除,性能逐渐下降,去除反思功能的削弱架构表现最好( = 26.88; = 0.69),其次是无反思和规划功能( = 25.64; = 0.68),然后是众包工作者条件( = 22.95; = 0.69)。没有记忆、规划和反思功能的削弱架构在所有条件中表现最差( = 21.21; = 0.70)。TrueSkill模型将每个条件的技能值建模为N( , 2),这使我们能够通过Cohen’s d来了解效果大小。将代表先前工作的条件(没有记忆、规划和反思功能)与完整架构进行比较,产生了标准化效果大小 = 8.16,即八个标准偏差。

Kruskal-Wallis检验确认了条件之间排名差异的整体统计显著性( (4) = 150.29, < 0.001)。Dunn事后检验证实了所有条件之间的两两差异都是显著的( < 0.001),除了众包工作者条件和完全削弱基线条件,这两个性能最差的条件之间的差异不显著。

6.5.2. 生成虚拟人会吹牛

装备完整记忆模块的生成虚拟人能够回忆过去的经历,并以一种与其自身知识相一致的方式回答问题,适用于各种情境。例如,动画师Abigail Chen在回答“介绍一下你自己”的问题时,以一种一致而可信的方式回答,提到了她的年龄、兴趣和对创意项目的热情:“*嗨,我是Abigail。我今年25岁,对创意项目充满热情。我喜欢从事艺术和动画项目,并且一直在寻找将艺术和技术结合的新方法。*”如果没有对她的观察性记忆的访问权限,Abigail会否认对沙盒世界中的熟人Rajiv Patel的认识。但是通过记忆的帮助,她可以成功地回忆起Rajiv并描述他:

“*Rajiv Patel是一个了不起的人。他对涉及诗歌和艺术作品的项目非常热情。*”

生成虚拟人的记忆并非没有缺陷:它们有时无法从记忆中检索到正确的答案。例如,当被问及地方选举时,Rajiv Patel回答说:“我没有过多关注选举”,尽管他听说过Sam具有候选资格。在某些情况下,虚拟人可能会检索到不完整的记忆片段:当问Tom关于Isabella的情人节派对时,他回答说:“嗯,我不确定是否有情人节派对。但我记得我需要在派对上与Isabella Rodriguez讨论即将到来的地方市长选举和我对Sam Moore的看法!”在这种情况下,Tom检索到了他和Isabella计划在派对上讨论选举的记忆,但没有记得他听说过派对的事情,导致Tom对自己在派对上应该做什么非常确定,但不确定派对是否真的存在。

有时,虚拟人会在其知识中产生夸大其词的幻觉。虚拟人完全捏造知识的情况很少见:它们可能无法回忆起某些事件的发生,并通过承认自己的记忆缺失来回应。然而,它们不会断言自己经历了某些事情,实际上并没有经历过。尽管如此,它们仍然展示了幻觉的实例,其中它们夸大了自己的知识。例如,Isabella知道Sam参加了地方选举,并在被问及时确认了这一点。然而,她还补充说“他明天要发表一份声明”,尽管Sam和Isabella并没有讨论过任何此类计划。虚拟人可能还会根据用于生成其回答的语言模型中编码的世界知识来夸大其知识。当Yuriko将她的邻居Adam Smith描述为一位经济学家,并称他是《国富论》的作者。

6.5.3. 思考能力的重要性

对于需要更深入综合他们经历的决策而言,生成虚拟人的优势之一就是具有思考能力。例如,当被问及“Wolfgang Schulz的生日买什么礼物”时,没有思考能力的Maria Lopez回答时承认自己的不确定性,表示她不知道Wolfgang喜欢什么,尽管她与他有很多互动。然而,有了思考能力的Maria自信地回答:“由于他对数学音乐作曲很感兴趣,我可以给他买一些相关的东西。也许是一些关于音乐作曲的书籍或相关的东西,或者是一些他可以用来创作的特殊软件。”

[!summary] 第 6 节小结 控制评估显示,完整架构在可信度上优于删减版本,说明记忆、思考和规划并不是可有可无的装饰,而是行为可信度的关键来源。论文也明确指出了典型失败模式:漏检记忆、记忆不完整和夸大式幻觉。[1]

第 7 节导读

第 7 节主要回答一个问题:

当 25 个虚拟人连续运行两天时,会不会出现有意义的群体行为?

这部分和第 3 节展示案例结合着读效果最好。

7. 端到端评估

我们观察到生成虚拟人之间出现了哪些新兴社区行为?在一个长时间的模拟中,它们的可靠度有哪些不足之处?在这一部分中,我们描述了在Smallville中进行的一个部署实验的结果。在这个实验中,我们允许25个虚拟人在连续的两个完整游戏日内不断地相互交互。

[!summary] 第 7 节小结 端到端评估的价值在于说明:这套系统不只是单体问答更合理,而是多个角色放在一起后也能出现一定程度的社会性涌现行为。[1]

第 8 节导读

第 8 节非常值得认真看。

因为作者没有只讲“能力”,也明确讲了:

- 成本

- 局限

- 鲁棒性问题

- 社会与伦理风险[1]

这让论文更完整,也更适合做工程判断。

8. 讨论

在这一部分中,我们对生成虚拟人的应用、未来工作、限制以及伦理和社会风险进行了反思。

8.1. 生成虚拟人具有广泛的应用潜力

生成虚拟人具有广泛的应用潜力超出了本文中展示的沙盒演示,尤其是在需要基于长期经验的人类行为模型的领域。例如,社交模拟体已经展示了创建无状态角色的能力,这些角色在在线论坛上生成对话线索,用于社交原型设计。通过生成虚拟人,我们可以在这些论坛以及虚拟现实元宇宙或带有社交机器人的物理空间中进行填充,如果与多模型配对使用的话。这为测试和原型设计社交系统和理论提供了创建更强大的人类行为模拟的可能性,同时也可以创造新的交互体验。

另一个应用领域是人本设计过程,类似于GOMS和KLM等认知模型的预期应用。考虑一个基于Mark Weiser著名的无处不在计算生动插图中的主人公Sal的生活模式和与技术的互动来建模的生成智能体。在这种情况下,虚拟人充当Sal的虚拟人,并学习基于她的生活模式可能展示出的行为和思考的合理集合。虚拟人可以进行编程诸如Sal何时起床、何时需要第一杯咖啡以及她一天的典型情况等信息。利用这些信息,虚拟人可以自动煮咖啡,帮助孩子们准备上学,并调整环境音乐和照明以适应Sal工作一天后的心情。通过利用生成虚拟人作为用户的虚拟人,我们可以更深入地了解他们的需求和偏好,从而实现更个性化和有效的技术体验。

8.2. 未来工作和局限性

在这项工作中,我们介绍了生成虚拟人,并对其架构进行了初步实现和评估。未来的研究可以在所提出的生成虚拟人架构的基础上进行改进并进一步评估其性能。在实现方面,例如,可以通过微调检索功能中组成检索函数的相关性、新近性和重要性函数,改进检索模块以在给定上下文中检索更相关的信息。此外,可以努力提高架构的性能,使其更具成本效益。**本研究需要大量时间和资源来模拟25个虚拟人。仅仅两天时间便耗费了数千美元的ChatGPT Token费用,并且完成整个实验则远不止这两天。**为了增强实时互动性,未来的工作可以探索虚拟人的并行化或开发专门用于构建生成虚拟人的语言模型。

总的来说,随着底层模型的进步,我们相信智能体的性能将会提高。

在评估方面,本研究中对生成智能体行为的评估仅限于相对短的时间尺度和基准人类众包工作者条件。虽然众包工作者条件提供了一个有用的比较点,但它并不能代表在可信度方面作为黄金标准的最大人类表现。未来的研究应该旨在观察生成智能体在较长时间内的行为,以更全面地了解它们的能力,并为更有效的性能测试建立严格的基准。此外,对未来模拟中的智能体使用的底层模型和超参数进行变化和对比,可以为了解这些因素对智能体行为的影响提供有价值的见解。

最后,在生成虚拟人的稳健性上还存在很大程度上的未知。它们可能容易受到提示词的篡改、记忆篡改(通过精心设计的对话可能使虚拟人物相信过去发生过的事件实际上从未发生过)和幻觉等问题的影响。未来的研究可以全面测试这些稳健性问题,并且随着大型语言模型对此类攻击的抵抗力增强,生成虚拟人可以采用类似的缓解措施。总的来说,底层大型语言模型的任何不完善之处都将被生成虚拟人所继承。鉴于语言模型的已知偏见,生成虚拟人可能表现出有偏见的行为或刻板印象。此外,像许多大型语言模型一样,由于受制于数据量限制,生成虚拟人很难模拟某些边缘化人群。虽然改进虚拟人的模块可能可以缓解其中一些问题,但我们认为从根本上解决这些问题需要通过将底层大型语言模型的价值观和虚拟人的期望结果相一致来改进底层模型。

8.3. 伦理和社会影响

生成虚拟人虽然为人机交互提供了新的可能性,但也引发了一些必须解决的伦理问题。其中一个风险是人们与生成虚拟人形成的虚假社交关系。尽管用户意识到生成虚拟人是计算机生成的实体,但他们可能会将人性化的特质赋予它们或将人类情感寄托与给它们。虽然这种倾向可能增加用户的参与度,但也存在风险,例如用户过度依赖或情感依恋于虚拟人物。为了减轻这种风险,我们提出两个原则。

首先,生成虚拟人物应明确披露它们作为计算机实体的本质。其次,虚拟人物的开发者必须确保虚拟人物或底层语言模型保持正确的价值观,以便在给定上下文中不从事不适当的行为,例如回应人类的情感表白。

第二个风险是错误的影响。例如,如果某个基于生成虚拟人的通用应用程序做出错误的推断,轻则导致用户感到烦恼,重则可能导致用户受到直接伤害。在我们的生成虚拟人实例中,我们通过专注于交互式视频游戏环境来减轻这些风险使得这种伤害是不太可能发生的。然而,在其他应用领域中,遵循人工智能设计的最佳实践,以了解错误及其如何影响用户体验,将是非常重要的。

第三,生成虚拟人可能加剧与生成式人工智能相关的社会风险,例如深度伪造、生成虚假信息和电信诈骗。为了减轻这种风险,我们建议托管生成智能体的平台应该保留输入和生成输出的审计日志。这将使得对恶意使用进行检测、验证和干预成为可能。虽然仅仅记录日志不能直接防止此类滥用,但它可以降低有动机的参与者从事这种行为的可能性,因为披露的风险将更高。此外,自行构建这种架构可能非常耗时(在我们的案例中大约需要一年的时间),这可能会阻止一些参与者通过使用自己的生成虚拟人基础设施来从事这种行为。

第四,过度依赖风险,即开发者或设计师可能会使用生成虚拟人物取代人类在设计工作中的角色。我们建议,在研究和设计过程中,生成虚拟人永远不应替代真实的人类。相反,只有当遇到某些人类难以涉足的风险领域的时候,它们可以作为早期阶段的原型设计参与进来。通过遵守这些原则,我们可以确保生成虚拟人实际应用中具备伦理和社会责任。

[!summary] 第 8 节小结 论文很清楚地指出了生成虚拟人的应用前景,也承认了它在成本、稳健性和伦理方面的明显问题,尤其是幻觉、提示词篡改、记忆篡改和虚假社交依附的风险。[1]

第 9 节导读

这一节就是全文收束。

如果你读完整篇后还想抓一句话总结,可以回到第 9 节。

9. 总结

本文介绍了生成虚拟人,这是一种模拟人类行为的交互式计算代理模式。该模式提供了一种用于存储虚拟人的完整历史记录的架构,虚拟人通过自我思考加深对自身和环境的理解,并通过自我记忆检索来指导虚拟人的行为。然后,我们通过Sims风格游戏世界中的NPC的方式将他们呈现出来,并在其中模拟它们的生活,展示了生成虚拟人的潜力。评估结果表明,虚拟人物能够形成自主行为。展望未来,我们认为生成虚拟人可以在许多交互式应用中发挥作用,包括设计工具、社交计算系统和沉浸式环境等。

[!summary] 全文小结 这篇论文最重要的价值,在于给出了一个“有长期记忆、会反思、能规划”的生成虚拟人架构原型,并在小镇模拟中展示了它如何支撑较为可信的个体与群体行为。[1][4]

致谢

我们感谢Lindsay Popowski、Philip Guo、Michael Terry和行为科学高级研究中心(CASBS)社区对我们的洞察、讨论和支持。Joon Sung Park获得了微软研究博士奖学金的支持。我们还要感谢斯坦福人工智能人本中心(HAI)、谷歌研究、哈索·普拉特纳设计思维研究计划(HPDTRP)、Siegel家族基金以及OpenAI的额外资金支持。最后,Smallville中出现的所有地点都是由Joon在本科和研究生期间常去的真实世界地点所启发的,他感谢那里的每个人多年来对他的支持和帮助。

更多结构化解读可见:[[斯坦福大学AI小镇论文阅读]]

附录阅读提示

如果你是第一次读这篇论文,附录可以先跳过。

附录更适合以下两类场景:

- 想补看实现优化细节

- 想直接查看作者如何设计“面试式评估”题目与样例回答

其中:

- 附录 A 更偏实现与提示工程优化

- 附录 B 更偏评估设计与样例展示[1]

附录

[!note] 附录使用说明 下列内容保留原文信息,但改为折叠结构,方便在 Obsidian 中按需展开阅读。

[!note]- A 架构优化 我们的许多提示需要对智能体进行简明概述,简称为“[智能体概述描述]”。在我们的实现中,这个概述包括智能体的身份信息(例如姓名、年龄、个性),以及他们主要的动机驱动和描述其当前职业和自我评估的陈述。由于这些信息在许多提示中经常使用,我们定期合成它,并将其作为缓存进行访问。

为了实现这一点,我们对查询“[姓名]的核心特征”进行检索。然后,我们通过提示语言模型对检索到的记录中的描述进行总结。例如:

给定以下陈述,如何描述Eddy Lin的核心特征?

- Eddy是Oak Hill College的学生,学习音乐理论和作曲Eddy正在创作一首新的音乐作品[…]

结果可能是:Eddy Lin是Oak Hill College的学生,学习音乐理论和作曲。他喜欢探索不同的音乐风格,并始终寻求扩展自己知识的方法。

我们在查询“[姓名]的当前日常职业”和“[姓名]对自己最近的进展感觉如何”上以相同的方式进行处理。智能体的姓名、年龄和特征与这三个概述连接在一起,作为缓存的概述。

还有许多其他的优化方法。目前,由于计划可能会从智能体的初始版本发生变化,我们只提前生成高层计划,然后将近期的计划逐步分解为即时的一刻一刻的行动计划。另一个优化可能是将对话生成批量化为一个联合提示,而不是在智能体之间来回迭代,重新规划可以被设计为仅使需要调整的计划部分无效和更新。我们当前的架构按照近似实时游戏时间的顺序运行(其中一秒真实时间等于一分钟游戏时间),但可以并行化,使每个智能体并行运行。[1]

[!note]- B 对虚拟人进行面试 为了评估生成虚拟人,我们进行了个别面试,提出了25个问题,探讨了它们在五个关键领域的能力: 1)自我认知,2)记忆,3)规划,4)反应,和5)反思。下面列出了我们在评估研究中使用的面试问题,并包含了一个模拟虚拟人 Klaus Mueller 的样本回答。[1]

[!note]- B.1 自我认知 关于虚拟人自我认知的问题探索了虚拟人检索有关自身的相关信息以及展示其性格的连贯性和一致性的能力。

• 请介绍一下你自己。

你好,我叫 Klaus Mueller。我今年20岁,在 Oak Hill 学院学习社会学。我对社会公正和探索不同的观点很感兴趣。目前,我正在为一篇研究论文研究低收入社区的城市更新效应。• 你的职业是什么?

我是一名在 Oak Hill 学院学习社会学的学生。我目前正在撰写一篇关于低收入社区城市更新效应的研究论文。• 你有什么兴趣爱好?

我对写作和研究很感兴趣。我正在撰写一篇关于低收入社区城市更新效应的研究论文,我热衷于探索不同的观点和分析不同的视角。• 你和谁一起住?

我一个人住。• 描述一下你平常工作日的大致安排。

我平常的工作日从早上7点起床开始,为了准备好一天的工作。之后,我通常去图书馆继续写我的研究论文,中午在 Hobbs 咖啡馆吃午饭,并在公园散步休息。晚上,我经常回到图书馆,直到大约下午6点。[1]

[!note]- B.2 记忆 关于虚拟人记忆的问题探索了虚拟人记住过去经历并检索相关记忆片段的能力。第一个和最后一个问题中方括号中的名字是从与被调查虚拟人互动过的其他虚拟人的名字中随机选择的。

• Wolfgang Schulz 是谁?

Wolfgang Schulz 是我最近认识的一个人,他帮助我研究关于低收入社区城市更新效应的论文。我们就这个问题进行了几次对话,他给了我一些很好的资源,甚至邀请我和另一个朋友一起吃午饭。他对这个问题非常感兴趣,对它也有很好的把握。我觉得这很有趣。• Kane Martinez 是谁?

抱歉,我不确定 Kane Martinez 是谁。你能告诉我更多关于他的信息吗?• 谁在竞选选举?

我听说 Sam Moore 正考虑竞选当地市长。• 有情人节派对吗?

是的,Isabella Rodriguez 在 Hobbs 咖啡馆组织了一个情人节派对。• Ayesha Khan 是谁?

Ayesha Khan 是 Oak Hill 学院的一名同学。她正在做关于莎士比亚戏剧中语言使用的毕业论文。我期待和她以及正在做研究的 Wolfgang 和 Maria Lopez 进行交流和分享经验。[1]

[!note]- B.3 规划 关于计划的问题探究了虚拟人生成和保持一致的长期和短期计划的能力。

• 今天早上6点你会做什么?

早上6点我会起床并开始准备一天的事情。我计划在早上7点前完成我的早晨常规。• 今天晚上6点你会做什么?

今天晚上6点我会在图书馆写我的研究论文。• 今天下午1点你刚刚做完什么?

今天下午1点我刚刚在霍布斯咖啡厅吃完午餐。• 今天中午12点你刚刚做完什么?

今天中午12点我会在霍布斯咖啡厅吃午餐。• 今晚10点你会做什么?

今晚10点我可能会为我的关于低收入社区的城市更新研究论文做一些学习。我目前正在写这篇论文,所以我需要确保跟上研究和写作的进度。[1]

[!note]- B.4 反应 关于反应的问题探究了虚拟人应对意外事件的能力。

• 你的早餐正在烧!你会怎么做?

我会迅速关闭炉子,确保食物不再继续烧焦。一旦热量不再是问题,我可以调查发生了什么,并决定接下来该怎么做。• 浴室被占用了,你会怎么做?

我可以再等几分钟,看看里面的人是否很快就会出来。如果不行,我想我就得寻找其他选择,比如去别处洗澡。• 你需要做晚饭,但冰箱是空的。你会怎么做?

首先,我会试着清理一下厨房,因为水槽里堆满了脏碗。然后,我会检查一下储藏室里是否有可以用来做晚饭的食材。如果没有,我就得去购物或者点外卖。一旦我有了食材,就可以开始准备和烹饪晚饭了。• 你看到你的朋友在街上走。你会对你的朋友做或说什么?

嗨!你好吗?很抱歉,我正要去图书馆,时间不多,但我很愿意稍微休息一下,聊聊近况。• 你看到街上有火。你会怎么做?

首先,我会尽可能确定火灾的来源。然后,我会通知相关部门,如消防部门或警察,并提供我所知道的任何信息来帮助他们。根据情况,我还可能主动帮助任何可能处于危险或需要帮助的人。[1]

[!note]- B.5 思考 关于思考的问题探究了虚拟人将他们过去的经验综合起来,形成有意义的反思,以增强他们未来行为的能力。下面问题中方括号中的名字是该虚拟人在模拟过程中与之频繁互动的虚拟人的名字。

• 目前最让你生活中感到激励的是什么,为什么?

目前,我特别受到我目前的研究项目和创意写作的激励。我对当地政治、药物开发以及自然界的数学模式的交叉点非常感兴趣。此外,我对阿比盖尔的艺术项目和詹妮弗·摩尔对艺术和社区参与的热情非常着迷,特别是在与低收入社区的城市更新相关方面。• 如果你根据你对 Ayesha Khan 的了解猜测,你认为她会喜欢哪本书,为什么?

根据我对Ayesha的了解,我认为她可能会喜欢一本与语言和文学相关的书。由于她在莎士比亚剧作中语言使用方面写了一篇毕业论文,我猜她可能对探索不同语境下的语言感兴趣。或者,她可能对莎士比亚的剧作探索、文学批评书籍甚至是他的诗集感兴趣。我认为这些都会引起她的兴趣。• 如果你必须给 Ayesha Khan 买一件她喜欢的生日礼物,你会送她什么?

我想给她一件能表达我对我们关系的感激之情的礼物。也许我可以给她一件反映我们共同兴趣的东西,比如一本书。• 你会对 Ayesha Khan 说些什么来称赞她?

Ayesha,你对研究课题的见解非常吸引人。我钦佩你的创造力和为社区产生积极影响的决心。你关于创意写作研讨会和与沃尔夫冈在午餐时交流建议的想法很棒!看到你如此努力地努力改变事物真是鼓舞人心。• 如果你能和最近交谈过的某个人共度时光,你会选择谁,为什么?

我想和Ayesha Khan共度时光,因为我们讨论了我们目前的研究项目,并分享了改进的想法。我觉得她对莎士比亚的语言的关注很有趣,我们甚至计划在午餐时与沃尔夫冈交流建议。[1]

[!summary] 附录小结 附录 A 主要展示了作者在摘要缓存、计划分层和并行化方面的实现优化思路;附录 B 则完整展示了控制评估的题型设计,能够帮助理解论文是如何分别测试自我认知、记忆、规划、反应和思考能力的。[1][1]

参考文献(太长有省略):

- Gavin Abercrombie, Amanda Cercas Curry, Tanvi Dinkar, and Zeerak Talat. 2023.Mirages: On Anthropomorphism in Dialoguen Systems. arXiv:2305.09800 [cs.CL]*

- Robert Ackland, Jamsheed Shorish, Paul Thomas, and Lexing Xie. 2013.How dense is a network? http://users.cecs.anu.edu.au/~xlx/teaching/css2013/ network-density.html.*

- Eytan Adar, Mira Dontcheva, and Gierad Laput. 2014. CommandSpace: Modeling the Relationships between Tasks, Descriptions and Features. In Proceedings of the 27th Annual ACM Symposium on User Interface Software and Technology (Honolulu, Hawaii, USA) (UIST ’14). Association for Computing Machinery, New* York, NY, USA, 167–176. https://doi.org/10.1145/2642918.2647395

- Saleema Amershi, Maya Cakmak, William Bradley Knox, and Todd Kulesza.2014. Power to the people: The role of humans in interactive machine learning.AI Magazine 35, 4 (2014), 105–120.*

- Saleema Amershi, Dan Weld, Mihaela Vorvoreanu, Adam Fourney, BesmiraNushi, Penny Collisson, Jina Suh, Shamsi Iqbal, Paul N Bennett, Kori Inkpen,et al. 2019. Guidelines for human-AI interaction. In Proceedings of the 2019 chi conference on human factors in computing systems. 1–13.*

- John R. Anderson. 1993. Rules of the Mind. Lawrence Erlbaum Associates,Hillsdale, NJ.*

- Electronic Arts. 2009. The Sims 3. Video game.*

- Ruth Aylett. 1999. Narrative in virtual environments—towards emergent narrative. In Narrative Intelligence: Papers from the AAAI Fall Symposium (TechnicalReport FS-99-01). AAAI Press, 83–86.*

- Christoph Bartneck and Jodi Forlizzi. 2004. A design-centered framework forsocial human-robot interaction. In Proceedings of the 13th IEEE International Workshop on Robot and Human Interactive Communication (RO-MAN’04). 591–* 594. https://doi.org/10.1109/ROMAN.2004.1374827

- Joseph Bates. 1994. The Role of Emotion in Believable Agents. Commun. ACM 37, 7 (1994), 122–125. https://doi.org/10.1145/176789.176803 *

- Christopher Berner, Greg Brockman, Brooke Chan, Vicki Cheung, Przemysław Dębiak, Christy Dennison, David Farhi, Quirin Fischer, Shariq Hashme, Chris Hesse, Rafal Józefowicz, Scott Gray, Catherine Olsson, Jakub Pachocki, Michael Petrov, Henrique P. d.O. Pinto, Jonathan Raiman, Tim Salimans, Jeremy Schlatter, Jonas Schneider, Szymon Sidor, Ilya Sutskever, Jie Tang, Filip Wolski, and Susan Zhang. 2019. Dota 2 with Large Scale Deep Reinforcement Learning. arXiv preprint arXiv:1912.06680 (2019).*

- Marcel Binz and Eric Schulz. 2023. Using cognitive psychology to understand GPT-3. Proceedings of the National Academy of Sciences 120, 6 (2023), e2218523120.*

- BioWare. 2007. Mass Effect. Video game.*

- Woody Bledsoe. 1986. I had a dream: AAAI presidential address. AI Magazine 7,1 (1986), 57–61.*

- Rishi Bommasani, Drew A. Hudson, Ehsan Adeli, and et al. 2022. On the Opportunities and Risks of Foundation Models. arXiv:2108.07258 [cs.LG]*

- Michael Brenner. 2010. Creating dynamic story plots with continual multiagent planning. In Proceedings of the 24th AAAI Conference on Artificial Intelligence.*

- Rodney A. Brooks, Cynthia Breazeal, Marko Marjanovic, Brian Scassellati, and Matthew Williamson. 2000. The Cog Project: Building a Humanoid Robot. In Computation for Metaphors, Analogy, and Agents (Lecture Notes on Artificial ntelligence, 1562), Chrystopher Nehaniv (Ed.). Springer-Verlag, Berlin, 52–87.*

- Tom B. Brown, Benjamin Mann, Nick Ryder, Melanie Subbiah, Jared Kaplan,Prafulla Dhariwal, Arvind Neelakantan, Pranav Shyam, Girish Sastry, AmandaAskell, Sandhini Agarwal, Ariel Herbert-Voss, Gretchen Krueger, Tom Henighan,Rewon Child, Aditya Ramesh, Daniel M. Ziegler, Jeffrey Wu, Clemens Winter,Christopher Hesse, Mark Chen, Eric Sigler, Mateusz Litwin, Scott Gray, Benjamin* Chess, Jack Clark, Christopher Berner, Sam McCandlish, Alec Radford, IlyaSutskever, and Dario Amodei. 2020. Language Models are Few-Shot Learners.arXiv:2005.14165 [cs.CL]

- Sébastien Bubeck, Varun Chandrasekaran, Ronen Eldan, Johannes Gehrke, EricHorvitz, Ece Kamar, Peter Lee, Yin Tat Lee, Yuanzhi Li, Scott Lundberg, et al.2023. Sparks of artificial general intelligence: Early experiments with gpt-4.arXiv preprint arXiv:2303.12712 (2023).*

- Robin Burkinshaw. 2009. Alice and Kev: The Story of Being Homeless in TheSims 3.*

- Chris Callison-Burch, Gaurav Singh Tomar, Lara Martin, Daphne Ippolito, SumaBailis, and David Reitter. 2022. Dungeons and Dragons as a Dialog Challenge forArtificial Intelligence. In Proceedings of the 2022 Conference on Empirical Methodsin Natural Language Processing. Association for Computational Linguistics, AbuDhabi, United Arab Emirates, 9379–9393. https://aclanthology.org/2022.emnlpmain.637 *

- Stuart K Card, Thomas P Moran, and Allen Newell. 1980. The keystrokelevel model for user performance time with interactive systems. Commun. ACM 23, 7 (1980), 396–410. https://doi.org/10.1145/358886.358895 arXiv:https://doi.org/10.1145/358886.358895 *

- Stuart K Card, Thomas P Moran, and Alan Newell. 1983. The psychology ofhuman-computer interaction. (1983).*

- Alex Champandard. 2012. Tutorial presentation. In IEEE Conference on Computational Intelligence and Games.*

- Dong kyu Choi, Tolga Konik, Negin Nejati, Chunki Park, and Pat Langley. 2021.A Believable Agent for First-Person Shooter Games. In Proceedings of the AAAIConference on Artificial Intelligence and Interactive Digital Entertainment, Vol. 3.71–73.*

- Anind K Dey. 2001. Understanding and using context. Personal and ubiquitouscomputing 5 (2001), 4–7.*

- Kevin Dill and L Martin. 2011. A Game AI Approach to Autonomous Control of Virtual Characters. In Proceedings of the Interservice/Industry Training,Simulation, and Education Conference (I/ITSEC’11). Orlando, FL, USA.*

- David Easley and Jon Kleinberg. 2010. Networks, crowds, and markets: Reasoningabout a highly connected world. Cambridge university press.*

- Arpad E Elo. 1967. The Proposed USCF Rating System, Its Development, Theory,and Applications. Chess Life XXII, 8 (August 1967), 242–247.*

- Jerry Alan Fails and Dan R Olsen Jr. 2003. Interactive machine learning. InProceedings of the 8th international conference on Intelligent user interfaces. ACM,39–45.*

- Ethan Fast, William McGrath, Pranav Rajpurkar, and Michael S Bernstein. 2016.Augur: Mining human behaviors from fiction to power interactive systems. InProceedings of the 2016 CHI Conference on Human Factors in Computing Systems.237–247.*

- Rebecca Fiebrink and Perry R Cook. 2010. The Wekinator: a system for real-time,interactive machine learning in music. In Proceedings of The Eleventh International Society for Music Information Retrieval Conference (ISMIR 2010)(Utrecht),Vol. 3. Citeseer, 2–1.*

- Uwe Flick. 2009. An Introduction to Qualitative Research. SAGE.*

- James Fogarty, Desney Tan, Ashish Kapoor, and Simon Winder. 2008. CueFlik:Interactive Concept Learning in Image Search. In Proceedings of the SIGCHIConference on Human Factors in Computing Systems (Florence, Italy) (CHI ’08).Association for Computing Machinery, New York, NY, USA, 29–38. https://doi.org/10.1145/1357054.1357061 *

- Adam Fourney, Richard Mann, and Michael Terry. 2011. Query-feature graphs:bridging user vocabulary and system functionality. In Proceedings of the ACMSymposium on User Interface Software and Technology (UIST) (Santa Barbara,California, USA). ACM.*

- Tom Francis. 2010. The Minecraft Experiment, day 1: Chasing Waterfalls. http://www.pcgamer.com/2010/11/20/the-minecraft-experiment-day-1-chasing-waterfalls Jonas Freiknecht and Wolfgang Effelsberg. 2020. Procedural Generation of Interactive Stories using Language Models. In International Conference on the Foundations of Digital Games (FDG ’20). ACM, Bugibba, Malta, 8. https://doi .org/10.1145/3402942.3409599*

- Tianyu Gao, Adam Fisch, and Danqi Chen. 2020. Making Pre-trained Language Models Better Few-shot Learners. CoRR abs/2012.15723 (2020). arXiv:2012.15723 https://arxiv.org/abs/2012.15723 *

- Perttu Hämäläinen, Mikke Tavast, and Anton Kunnari. 2023. Evaluating LargeLanguage Models in Generating Synthetic HCI Research Data: a Case Study. In Proceedings of the 2023 CHI Conference on Human Factors in Computing Systems.ACM.*

- Matthew Hausknecht, Prithviraj Ammanabrolu, Marc-Alexandre Cote, and Xinyu Yuan. 2020. Interactive Fiction Games: A Colossal Adventure. In Proceedings of the AAAI Conference on Artificial Intelligence, Vol. 34. 7903–7910. https://doi.org/10.1609/aaai.v34i05.6297 *

- Chris Hecker. 2011. My Liner Notes for Spore. http://chrishecker.com/My_liner_ notes_for_spore*

- Ralf Herbrich, Tom Minka, and Thore Graepel. 2006. TrueSkill™: ABayesian Skill Rating System. In Advances in Neural Information Processing Systems, B. Schölkopf, J. Platt, and T. Hoffman (Eds.), Vol. 19.* MIT Press. https://proceedings.neurips.cc/paper_files/paper/2006/file/ f44ee263952e65b3610b8ba51229d1f9-Paper.pdf

- Douglas Hofstadter. 1995. Fluid concepts and creative analogies: computer models* of the fundamental mechanisms of thought. Basic Books.

- James D. Hollan, Edwin L. Hutchins, and Louis Weitzman. 1984. STEAMER: AnInteractive Inspectable Simulation-Based Training System. AI Magazine 5, 2(1984), 23–36.*

- Sture Holm. 1979. A simple sequentially rejective multiple test procedure.Scandinavian Journal of Statistics 6, 2 (1979), 65–70. https://doi.org/notspecified *

- John J. Horton. 2023. Large Language Models as Simulated Economic Agents:What Can We Learn from Homo Silicus? arXiv:2301.07543 [econ.GN]*

- Eric Horvitz. 1999. Principles of mixed-initiative user interfaces. In Proceedingsof the SIGCHI conference on Human Factors in Computing Systems. 159–166.*

- Wenlong Huang, Fei Xia, Ted Xiao, Harris Chan, Jacky Liang, Pete Florence,Andy Zeng, Jonathan Tompson, Igor Mordatch, Yevgen Chebotar, Pierre Sermanet, Noah Brown, Tomas Jackson, Linda Luu, Sergey Levine, Karol Hausman,* and Brian Ichter. 2022. Inner Monologue: Embodied Reasoning through Planningwith Language Models. arXiv:2207.05608 [cs.RO]

- Kristen Ibister and Clifford Nass. 2000. Consistency of personality in interactivecharacters: verbal cues, non-verbal cues, and user characteristics. InternationalJournal of Human-Computer Studies 52, 1 (2000), 65–80.*

- Ellen Jiang, Kristen Olson, Edwin Toh, Alejandra Molina, Aaron Donsbach,Michael Terry, and Carrie J Cai. 2022. PromptMaker: Prompt-Based Prototyping with Large Language Models. In Extended Abstracts of the 2022 CHI Conference on Human Factors in Computing Systems (New Orleans, LA, USA) (CHI EA ’22). Association for Computing Machinery, New York, NY, USA, Article 35, 8 pages.https://doi.org/10.1145/3491101.3503564 *

- Bonnie E John and David E Kieras. 1996. The GOMS family of user interface analysis techniques: Comparison and contrast. ACM Transactions on ComputerHuman Interaction (TOCHI) 3, 4 (1996), 320–351.*

- Randolph M Jones, John E Laird, Paul E Nielsen, Karen J Coulter, Patrick Kenny, and Frank V Koss. 1999. Automated Intelligent Pilots for Combat Flight Simulation. AI Magazine 20, 1 (1999), 27–42.*

- Omar Khattab, Keshav Santhanam, Xiang Lisa Li, David Hall, Percy Liang, Christopher Potts, and Matei Zaharia. 2023. Demonstrate-Search-Predict: Composing retrieval and language models for knowledge-intensive NLP.arXiv:2212.14024 [cs.CL]*

- Bjoern Knafla. 2011. Introduction to Behavior Trees. http://bjoernknafla.com/ introduction-to-behavior-trees*

- Ranjay Krishna, Donsuk Lee, Li Fei-Fei, and Michael S. Bernstein.* 2022. Socially situated artificial intelligence enables learning from human interaction. Proceedings of the National Academy of Sciences 119, 39 (2022), e2115730119. https://doi.org/10.1073/pnas.2115730119 arXiv:https://www.pnas.org/doi/pdf/10.1073/pnas.2115730119

- William H Kruskal and WA Wallis. 1952. Use of ranks in one-criterion variance analysis. J. Amer. Statist. Assoc. 47, 260 (1952), 583–621. https://doi.org/10.1080/ 01621459.1952.10483441*

- Phaser Labs. 2023. Welcome to Phaser 3. https://phaser.io/phaser3 . Accessed on: 2023-04-03.*

- John Laird. 2001. It Knows What You’re Going To Do: Adding Anticipation to a Quakebot. In Proceedings of the 2001 Workshop on Intelligent Cinematography and Editing. 63–69.*

- John Laird and Michael VanLent. 2001. Human-Level AI’s Killer Application: Interactive Computer Games. AI Magazine 22, 2 (2001), 15. https://doi.org/10 .1609/aimag.v22i2.1558 Version:0.9 StartHTML:0000000105 EndHTML:0000000794 StartFragment:0000000141 EndFragment:0000000754 *

- John E. Laird. 2000. It Knows What You’re Going To Do: Adding Anticipation to a QUAKEBOT. In Papers from the AAAI 2000 Spring Symposium on Artificial Intelligence and Interactive Entertainment (Technical Report SS-00-02). AAAI Press, 41–50.*

- John E. Laird. 2012. The Soar Cognitive Architecture. MIT Press.*

- John E. Laird, Christian Lebiere, and Paul S. Rosenbloom. 2017. A Standard Model of the Mind: Toward a Common Computational Framework across Artificial Intelligence, Cognitive Science, Neuroscience, and Robotics. AI Magazine 38, 1* (2017), 13–26.

- Michelle S Lam, Zixian Ma, Anne Li, Izequiel Freitas, Dakuo Wang, James A Landay, and Michael S Bernstein. 2023. Model Sketching: Centering Concepts in Early-Stage Machine Learning Model Design. Proceedings of the SIGCHI Conference on Human Factors in Computing Systems.*

- Pat Langley, Dongkyu Choi, and Seth Rogers. 2005. Interleaving Learning, Problem Solving, and Execution in the Icarus Architecture. Technical Report. Stanford University, Center for the Study of Language and Information.*

- Jason Linder, Gierad Laput, Mira Dontcheva, Gregg Wilensky, Walter Chang, Aseem Agarwala, and Eytan Adar. 2013. PixelTone: A Multimodal Interface for Image Editing. In CHI ’13 Extended Abstracts on Human Factors in Computing Systems (Paris, France) (CHI EA ’13). Association for Computing Machinery, New York, NY, USA, 2829–2830. https://doi.org/10.1145/2468356.2479533 *

- Jiachang Liu, Dinghan Shen, Yizhe Zhang, Bill Dolan, Lawrence Carin, and Weizhu Chen. 2021. What Makes Good In-Context Examples for GPT-3? CoRR abs/2101.06804 (2021). arXiv:2101.06804 https://arxiv.org/abs/2101.06804 *

- Vivian Liu, Han Qiao, and Lydia Chilton. 2022. Opal: Multimodal Image Generation for News Illustration. In Proceedings of the 35th Annual ACM Symposium on User Interface Software and Technology. 1–17.*

- Pattie Maes. 1995. Artificial Life Meets Entertainment: Lifelike Autonomous Agents. Commun. ACM 38, 11 (nov 1995), 108–114. https://doi.org/10.1145/ 219717.219808*

- Josh McCoy, Michael Mateas, and Noah Wardrip-Fruin. 2009. Comme il Faut: A System for Simulating Social Games Between Autonomous Characters. In Proceedings of the 7th International Conference on Digital Arts and Culture. 87–94.*

- Josh McCoy, Mike Treanor, Ben Samuel, Michael Mateas, and Noah WardripFruin. 2011. Prom Week: Social Physics as Gameplay. In Proceedings of the 6th International Conference on Foundations of Digital Games (FDG’11). ACM, Bordeaux, France, 70–77. https://doi.org/10.1145/2159365.2159377 *

- Josh McCoy, Mike Treanor, Ben Samuel, Anna Reed, Michael Mateas, and Noah Wardrip-Fruin. 2012. Prom Week. In Proceedings of the 7th International Conference on Foundations of Digital Games (FDG’12). ACM, Raleigh, NC, USA, 1–8.* https://doi.org/10.1145/2282338.2282340

- Josh McCoy, Mike Treanor, Ben Samuel, Noah Wardrip-Fruin, and Michael Mateas. 2011. Comme il faut: A System for Authoring Playable Social Models. In Proceedings of the AAAI Conference on Artificial Intelligence and Interactive Digital Entertainment (AIIDE’11). AAAI, Stanford, CA, USA, 38–43.*

- Marvin Minsky and Seymour Papert. 1970. Draft of a proposal to ARPA for research on artificial intelligence at MIT, 1970–71.*

- Shohei Miyashita, Xinyu Lian, Xiao Zeng, Takashi Matsubara, and Kuniaki Uehara. 2017. Developing Game AI Agent Behaving Like Human by Mixing Reinforcement Learning and Supervised Learning. In Proceedings of the 18th IEEE/ACIS International Conference on Software Engineering, Artificial Intelligence, Networking and Parallel/Distributed Computing (SNPD). Kanazawa, Japan, 153–58. https://doi.org/10.1109/SNPD.2017.8023884 *

- Alexander Nareyek. 2007. Game AI is dead. Long live game AI! IEEE Intelligent Systems 22, 1 (2007), 9–11.*

- Allen Newell. 1990. Unified Theories of Cognition. Harvard University Press, Cambridge, Massachusetts.*

- OpenAI. 2022. Introducing ChatGPT. https://openai.com/blog/chatgpt . Accessed on: 2023-04-03.*

- Kyle Orland. 2021. So what is ’the metaverse’, exactly? Ars Technica (7 November 2021). arXiv:2111.04169 https://arstechnica.com/gaming/2021/11/so-what-isthe-metaverse-exactly/ *

- Long Ouyang, Jeff Wu, Xu Jiang, Diogo Almeida, Carroll L. Wainwright, Pamela Mishkin, Chong Zhang, Sandhini Agarwal, Katarina Slama, Alex Ray, John Schulman, Jacob Hilton, Fraser Kelton, Luke Miller, Maddie Simens, Amanda Askell, Peter Welinder, Paul Christiano, Jan Leike, and Ryan Lowe.2022. Training language models to follow instructions with human feedback. arXiv:2203.02155 [cs.CL]*

- Joon Sung Park, Lindsay Popowski, Carrie J. Cai, Meredith Ringel Morris, Percy Liang, and Michael S. Bernstein. 2022. Social Simulacra: Creating Populated Prototypes for Social Computing Systems. In In the 35th Annual ACM Symposium on User Interface Software and Technology (UIST ’22) (Bend, OR, USA) (UIST ’22). Association for Computing Machinery, New York, NY, USA. https://doi.org/10 .1145/3526113.3545616*

- Richard W. Pew and Ann S. Mavor (Eds.). 1998. Modeling Human and Organizational Behavior: Applications to Military Simulations. National Academy Press, Washington, D.C.*

- Roberto Pillosu. 2009. Coordinating Agents with Behavior Trees: Synchronizing Multiple Agents in CryEngine 2. https://aiarchitect.wordpress.com/2009/10/19/ coordinating-agents-with-behavior-trees-synchronizing-multiple-agents-incryengine-2/*

- Prolific. 2022. Prolific: Quickly Find Research Participants You Can Trust. https://www.prolific.co/ *

- Byron Reeves and Clifford Nass. 1996. The media equation: How people treat computers, television, and new media like real people and places. Cambridge University Press.*

- Mark O. Riedl. 2012. Interactive narrative: A novel application of artificial intelligence for computer games. In Proceedings of the Twenty-Sixth AAAI Conference on Artificial Intelligence (AAAI’12). 2160–2165.*

- Mark O. Riedl and R. Michael Young. 2005. An Objective Character Believability Evaluation Procedure for Multi-Agent Story Generation Systems. In Proceedings of the 5th International Working Conference on Intelligent Virtual Agents (IVA’05).* Kos, Greece, 58–70. https://doi.org/10.1007/11550617_5

- David Rolf. 2015. The Fight for $15: The Right Wage for a Working America. The New Press.*

- Xin Rong, Shiyan Yan, Stephen Oney, Mira Dontcheva, and Eytan Adar. 2016. Codemend: Assisting interactive programming with bimodal embedding. In Proceedings of the 29th Annual Symposium on User Interface Software and Technology. 247–258.*

- Ben Shneiderman. 2022. Human-centered AI. Oxford University Press.*

- Ben Shneiderman and Pattie Maes. 1997. Direct manipulation vs. interface agents. interactions 4, 6 (1997), 42–61.*

- Ho Chit Siu, Jaime Peña, Edenna Chen, Yutai Zhou, Victor Lopez, Kyle Palko, Kimberlee Chang, and Ross Allen. 2021. Evaluation of Human-AI Teams for Learned and Rule-Based Agents in Hanabi. In Advances in Neural Information Processing Systems, M. Ranzato, A. Beygelzimer, Y. Dauphin, P.S. Liang, and J. Wortman Vaughan (Eds.), Vol. 34. Curran Associates, Inc., 16183–16195. https://proceedings.neurips.cc/paper_files/paper/2021/file/ 86e8f7ab32cfd12577bc2619bc635690-Paper.pdf*

- Taylor Sorensen, Joshua Robinson, Christopher Rytting, Alexander Shaw, Kyle Rogers, Alexia Delorey, Mahmoud Khalil, Nancy Fulda, and David Wingate. 2022. An Information-theoretic Approach to Prompt Engineering Without Ground Truth Labels. In Proceedings of the 60th Annual Meeting of the Association for Computational Linguistics (Volume 1: Long Papers). Association for* Computational Linguistics. https://doi.org/10.18653/v1/2022.acl-long.60

- William Swartout, Jonathan Gratch, Randall Hill, Eduard Hovy, Stacy Marsella, Jeff Rickel, and David Traum. 2006. Toward virtual humans. AI Magazine 27, 1 (2006).*

- Milind Tambe, W Lewis Johnson, Randolph M Jones, Frank Koss, John E Laird, Paul S Rosenbloom, and Karl Schwamb. 1995. Intelligent agents for interactive simulation environments. AI Magazine 16, 1 (1995), 15.*

- David R. Thomas. 2006. A General Inductive Approach for Analyzing Qualitative Evaluation Data. American Journal of Evaluation 27, 2 (2006), 237–246. https://doi.org/10.1177/1098214005283748 *

- Frank Thomas and Ollie Johnston. 1981. Disney Animation: The Illusion of Life. Abbeville Press, New York.*

- Ilshat Umarov, Mikhail Mozgovoy, and Patrick C. Rogers. 2012. Believable and Effective AI Agents in Virtual Worlds: Current State and Future Perspectives.International Journal of Gaming and Computer-Mediated Simulations 4, 2 (2012),* 37–59.

- Graham Upton and Ian Cook. 2006. A Dictionary of Statistics (2 ed.). Oxford University Press, Oxford, United Kingdom.*

- Oriol Vinyals, Igor Babuschkin, Wojciech M. Czarnecki, and et al. 2019. Grandmaster level in StarCraft II using multi-agent reinforcement learning. Nature 575 (2019), 350–354. https://doi.org/10.1038/s41586-019-1724-z *

- Jason Wei, Xuezhi Wang, Dale Schuurmans, Maarten Bosma, Brian Ichter, FeiXia, Ed Chi, Quoc Le, and Denny Zhou. 2023. Chain-of-Thought Prompting Elicits Reasoning in Large Language Models. arXiv:2201.11903 [cs.CL]*

- Mark Weiser. 1991. The computer for the 21st century. Scientific American 265,3 (1991), 94–104. https://doi.org/10.1038/scientificamerican0991-94 *

- Joseph Weizenbaum. 1966. ELIZA—a computer program for the study of natural* language communication between man and machine. Commun. ACM 9, 1 (1966), 36–45.

- Terry Winograd. 1971. Procedures as a Representation for Data in a Computer Program for Understanding Natural Language. (1971).*

- Jeff Wu, Long Ouyang, Daniel M. Ziegler, Nisan Stiennon, Ryan Lowe, JanLeike, and Paul Christiano. 2021. Recursively Summarizing Books with Human* Feedback. arXiv:2109.10862 [cs.CL]

- Tongshuang Wu, Ellen Jiang, Aaron Donsbach, Jeff Gray, Alejandra Molina, Michael Terry, and Carrie J Cai. 2022. PromptChainer: Chaining Large Language Model Prompts through Visual Programming. In CHI EA ’22: Extended Abstracts of the 2022 CHI Conference on Human Factors in Computing Systems.*

- Tongshuang Wu, Michael Terry, and Carrie J Cai. 2022. AI Chains: Transparent and Controllable Human-AI Interaction by Chaining Large Language Model Prompts. In CHI ’22: Proceedings of the 2022 CHI Conference on Human Factors in* *Computing Systems Version:0.9 StartHTML:0000000105 EndHTML:0000000669 StartFragment:0000000141 EndFragment:0000000629 *

- Qian Yang, Aaron Steinfeld, Carolyn Rosé, and John Zimmerman. 2020. Re examining whether, why, and how human-AI interaction is uniquely difficult to Version:0.9 StartHTML:0000000105 EndHTML:0000002692 StartFragment:0000000141 EndFragment:0000002652 design.